En réponse à NVIDIA et à Chat With RTX, AMD souhaite aussi proposer des LLM natifs aux machines des utilisateurs. Pour cela la firme utilise LM Studio, un outil qui permet de converser avec différents chatbots directement depuis le PC des usagers.

Depuis quelque temps, l’intelligence artificielle est entrée dans la vie de nombreux utilisateurs. Cette technologie, popularisée par la sortie de Chat GPT, est un outil intéressant capable du meilleur comme du pire.

En général, la plupart des LLM (grands modèles de langage) comme Gemini ou le chatbot d’Open AI sont accessibles uniquement via des serveurs internet. Cependant, certaines entreprise souhaitent permettre aux usagers d’utiliser l’IA directement depuis leur PC.

C’est le cas notamment de NVIDIA qui vient de lancer Chat With RTX, un chatbot utilisant les cartes graphiques GeForce des utilisateurs pour fonctionner. Évidemment AMD veut aussi sa part du gâteau et vient profiter d’une solution indépendante : LM Studio pour offrir un service similaire à celui de NVIDIA.

Comment fonctionne LM Studio ?

Cette outil fonctionne de la même manière que celui de NVIDIA et est relativement exigeant. Tout comme Chat With RTX qui ne marche que sur les GPU des séries 30 et 40 comme la GeForce RTX 4070 TI Super, LM Studio demande une configuration récente pour fonctionner sur un système AMD.

Contrairement aux 8 Go de RAM demandés par Chat With RTX, LM Studio nécessite 16 Go de RAM et 6 Go de VRAM. De plus, il faut préciser qu’il n’est pas exclusif à AMD, il peut aussi être utilisé depuis un Mac (M1, M2 et M3 sous macOS 13.6) et sur les systèmes NVIDIA.

Sur une machine AMD, LM Studio requiert une carte Radeon RX 7000 comme les RX 7900 XT et XTX ou un processeur utilisant l’architecture Zen 4 comme les Ryzen 7000. Les pocesseurs de Ryzen 7000 peuvent télécharger une copie de LM Studio. Pour ceux ayant une carte graphique Radeon, ils devront utiliser la preview technique du logiciel ROCm d’AMD.

Comment installer le chatbot LM Studio sur un système AMD ?

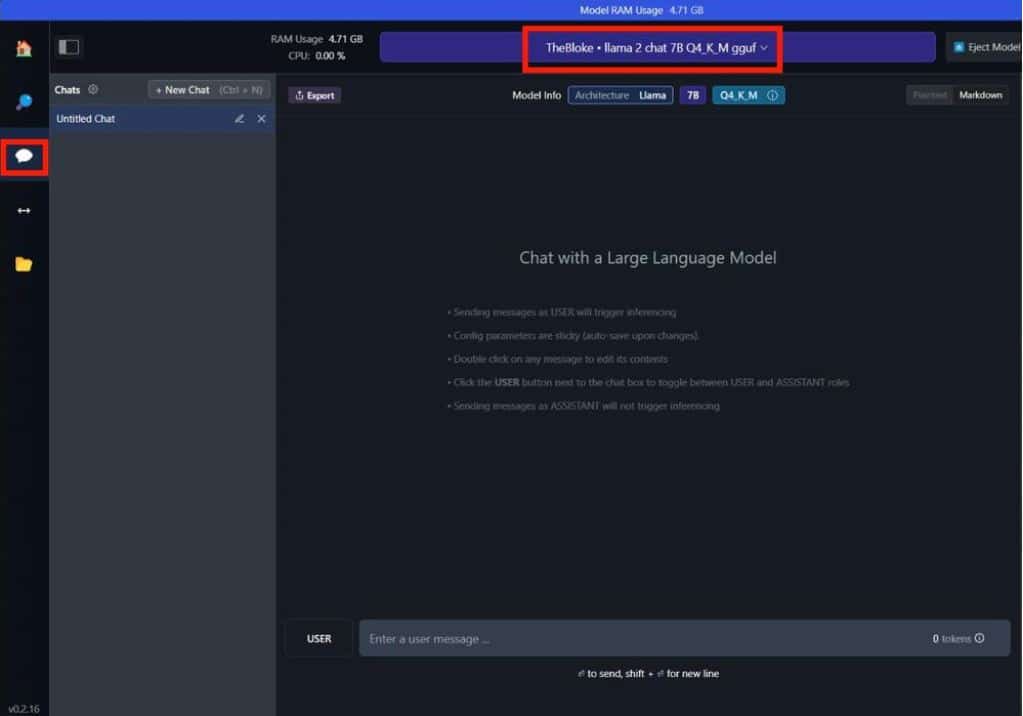

LM Studio fait également appel à différents LLM pour fonctionner dont Mistral, un modèle made in France ou encore LLAMA v2. Pour mettre la main sur cet outil, AMD a mis en ligne un guide d’installation et d’utilisation en quelques étapes.

- Téléchargez la bonne version de LM Studio :

- Pour les CPU : LM Studio pour Windows

- Pour les GPU : la preview technique ROCm

- Lancez le fichier.

- Dans la barre de recherche, copiez-collez les commandes suivantes en fonction de l’utilisation recherchée :

- Pour utiliser Mistral 7b : TheBloke/OpenHermes-2.5-Mistral-7B-GGUF.

- Pour utiliser LLAMA v2 7b : TheBloke/Llama-2-7B-Chat-GGUF.

- Il est toujours possible d’expérimenter avec d’autres LLM.

- Sur le panneau à droite, défilez vers le bas jusqu’à atteindre le modèle de fichier Q4 K M et téléchargez-le.

- Il est recommandé d’utiliser Q4 K M sur la plupart des modèles de Ryzen IA. Patientez jusqu’à la fin du téléchargement.

- Allez dans l’onglet de Chat. Sélectionnez le modèle dans la liste déroulante et attendez jusqu’à la fin du chargement.

- Si vous avez un CPU Ryzen IA, vous pouvez lancer la discussion ! Si vous avez une carte graphique Radeon, suivez les instructions suivantes :

- Vérifiez l’option “GPU Offload” sur le panneau de droite.

- Déplacez le slider à la valeur maximale.

- Vérifiez que ROCm est bien affiché comme le type de GPU détecté.

- Lancez la discussion !

- AMD s’attaque à l’intelligence artificielle et propose d’utiliser l’outil “LM Studio” directement depuis un PC.

- LM Studio permet d’accèder à divers modèles de language (LLM) sans passer par internet.

- Sur un PC AMD, LM Studio nécessite un CPU Ryzen 7000 ou un GPU Radeon RX 7000 pour fonctionner.

Il me semble que LM Studio est un utilitaire gratuit indépendant d’AMD (et existant déjà depuis un moment), de même que les modèles d’IA proposés, et que tout ça fonctionne aussi de la même manière sur une Geforce.

Après certes, il se pourrait aussi que Chat with RTX ne soit qu’un emballage made in nVidia autour de choses qui sont nettement plus génériques aussi, mais bon, chacun y va de sa coup de comm un peu pompeuse.

Bonjour,

Vous avez raison, LM Studio est effectivement indépendant d’AMD. Veuillez m’excuser pour la confusion, c’est corrigé.