Metro Exodus nous promet du ray-tracing et du DLSS dès son lancement, nous avons donc tout testé !

Moteur 3D, configs conseillées

Metro Exodus s’annonce comme l’un des blockbusters de l’année, et semble déjà bien noté par la presse. Mais notre test se gardera bien de juger le jeu en lui-même : nous étudierons plutôt son aspect « bardé de technologies ». Car Exodus est encore plus poussé que Battlefield V à sa sortie. Il passe du côté vert pour adopter les technologies NVIDIA du moment : ray tracing, DLSS, mais aussi Advanced PhysX et HairWorks, histoire de ne pas faire les choses à moitié. Mais qu’est-ce que ça donne en pratique ? Notre analyse en profondeur nous permettra de le savoir.

Metro Exodus

45€Moteur 3D : 4A Engine

Metro Exodus exploite un moteur 3D 4A Engine, fait maison chez 4A Games, à l’origine pour Metro 2033. Le moteur a évolué et gère désormais DirectX 12 en plus de DirectX 11, notamment afin de gérer les technologies RTX (DXR) et DLSS. Les autres technologies Advanced PhysX et Hairworks fonctionnent aussi en DirectX 11. Notez que l’Advanced PhysX n’utilise pas le GPU mais le CPU, en tout cas dans la version actuelle du jeu. Quant au ray tracing, il est ici exploité pour gérer l’illumination globale du soleil, alors qu’il est en charge des reflets dans Battlefield V.

Séquence de bench

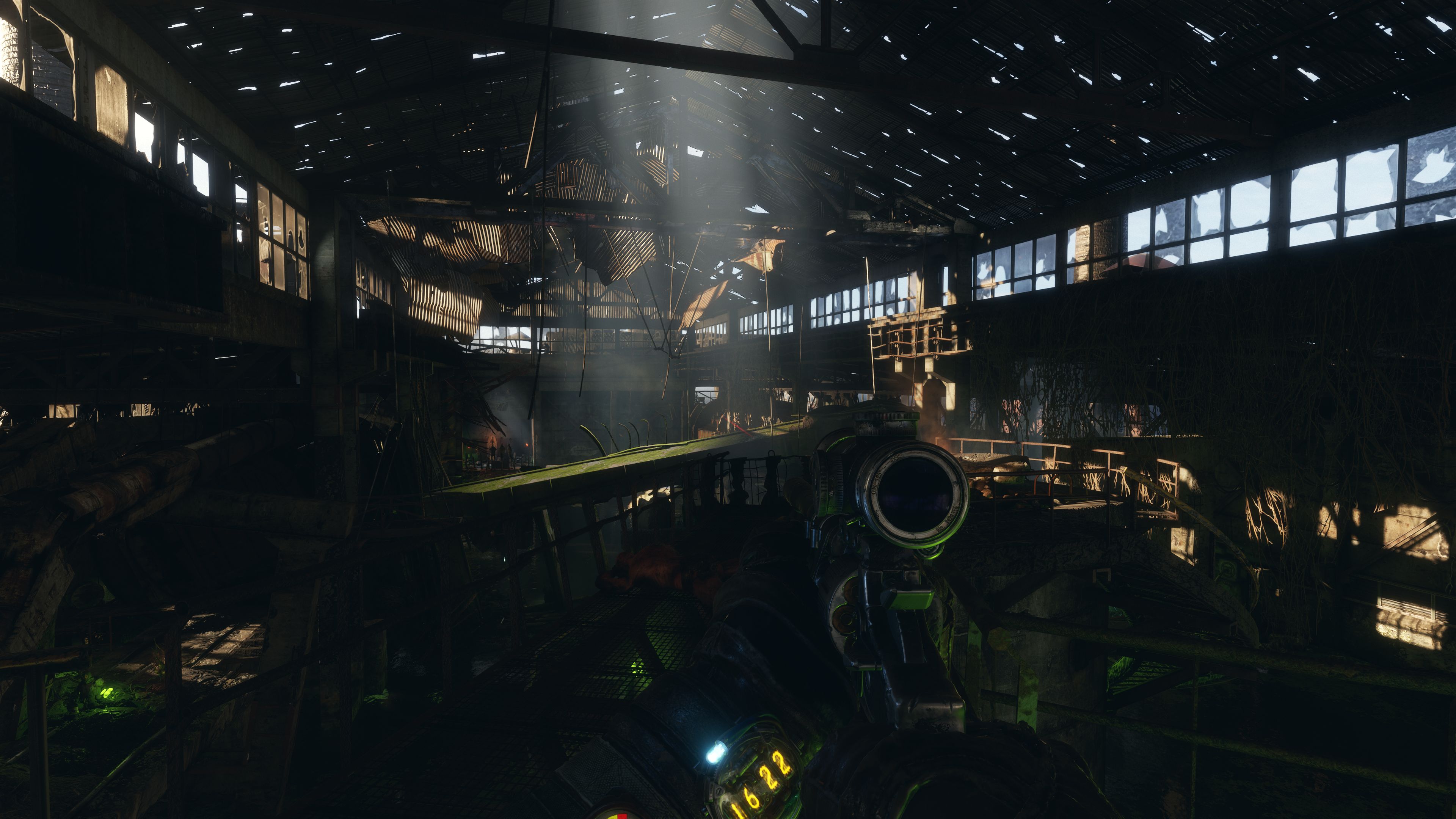

Metro Exodus possède un benchmark intégré, mais il semblerait selon nos premiers tests que celui-ci pose quelques problèmes avec le DLSS. Il nous a donc fallu choisir un autre passage du jeu pouvant servir de séquence de test. Notre choix s’est porté sur le début de La Caspienne, les cartes précédentes n’étant tout simplement pas propices à mettre en valeur l’illumination globale par ray-tracing. La séquence exacte de test est visible ci-dessous :

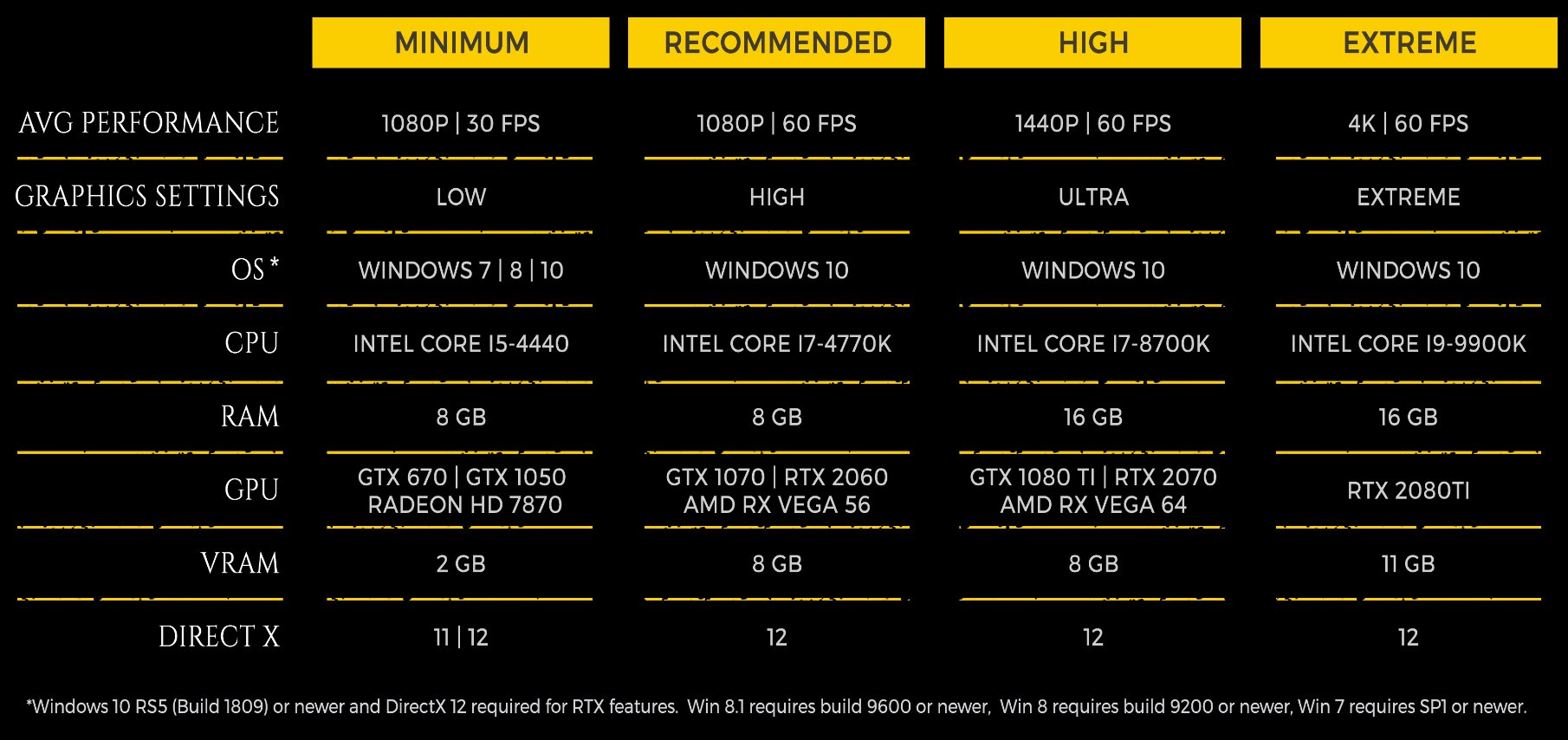

Configurations minimales et conseillées

Le moteur semble assez souple pour s’adapter à pas mal de configs PC, à condition évidemment d’avoir un GPU dédié. Une ancienne carte graphique ou une carte actuelle d’entrée de gamme devrait permettre de jouer à 30 ips en Full HD. Et pour jouer en Extreme, une RTX 2080 Ti est conseillée. Notez que l’éditeur ne précise pas de configuration pour les technologies RTX que nous allons tester dans ce dossier. Il faudra donc vous fier à nos résultats !

Méthode de test et cartes choisies

Configuration de test

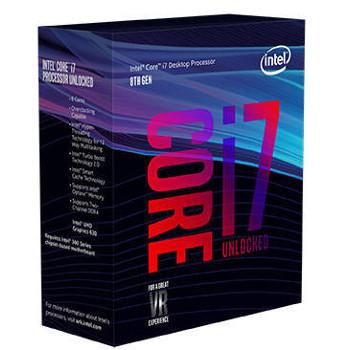

Afin de ne pas être limité par notre configuration classique de test, basée sur un Ryzen 5 1600X et typique d’une machine de milieu de gamme, nous avons cette fois-ci choisi d’utiliser une configuration haut de gamme à base de processeur Core i7-8700K. Pour l’occasion, celui-ci à été overclocké à 5 GHz sur l’ensemble de ses coeurs et le TDP à été fixé à 175 watts sans limite de durée, afin de lui donner un peu de réserve de puissance. De cette façon, même la RTX 2080 Ti pourra pleinement s’exprimer sans être limitée par le CPU !

Intel Core i7-8700K

434.00€ > Amazon

SuperMicro C9Z390-PGW

400 $€ > Amazon US

G.SKill Sniper X DDR4-3400 CL16

241.95€ > Amazon

PNY SSD CS900 480 Go

64.99€ > Amazon

Alimentation Corsair HX750

137.03€ > Amazon

Noctua NT-H1

7.90€ > Amazon

Alphacool Eisbaer 280 CPU

140.59€ > Amazon| OS | |

| Système d’exploitation | Windows 10 x64 Home 1809 (17763.316) |

| Pilotes | Le jeu a été testé avec les pilotes les plus récents disponibles au moment des benchs : NVIDIA GeForce 417.71 |

| Jeu | Le jeu a été testé dans sa version la plus récente disponible au moment des benchs : Metro Exodus (0.1.0.7) |

Le choix des cartes graphiques

A ce jour, les cartes graphiques prenant en charge le ray tracing via l’API DXR et le DLSS se comptent sur les doigts d’une main. Nous avons donc réuni pour ce test les quatre modèles concernés de chez NVIDIA, à savoir les GeForce RTX 2080 Ti, RTX 2080, RTX 2070 et RTX 2060.

NVIDIA GeForce RTX 2080 Ti FE

1259.00€ > NVIDIA

PNY GeForce RTX 2080 XLR8 Gaming OC Twin Fan

869.90€ > Top Achat

EVGA GeForce RTX 2070 XC

549.90€ > Amazon

NVIDIA GeForce RTX 2060 FE

369.00€ > NVIDIA Store

Protocole de test

Nous effectuons toutes les mesures avec l’outil PresentMon et le GUI programmé par notre testeur allemand Igor Wallossek, qui permet d’effectuer de nombreuses mesures simultanées, sans compter la génération de graphiques très précis.

Pour que les performances des cartes graphiques soient vraiment représentatives de la réalité, nous prenons soin de les faire chauffer avant de relever nos mesures. En effet, la majorité des cartes graphiques ont une fréquence qui se stabilise avec la température de leur GPU, et faire des mesures dès les premières minutes de fonctionnement conduirait à constater des performances supérieures à la réalité.

Nous laissons donc la carte atteindre sa température de fonctionnement nominale, puis nous relevons les mesures de ses performances lors de la séquence de test. Pour les options graphiques, nous avons testé le jeu en Full HD, QHD et 4K avec les options réglées sur Ultra comme le recommande NVIDIA. Nous avons également testé le ray-tracing avec le réglage High, ici aussi comme recommandé par NVIDIA. Le flou de mouvement est réglé le plus bas possible (il n’est pas possible de le désactiver).

Options graphiques, rendu RTX et DLSS

Ray tracing : belle simulation du soleil

Le ray Tracing s’observe plutôt bien en intérieur, même s’il est aussi bénéfique en extérieur pour affiner l’éclairage du soleil du les objets et bâtiments. Pour bien comprendre, ces deux comparaisons montrent comment la lumière du ciel se diffusera de manière plus réaliste à l’intérieur d’un bâtiment. En extérieur, notre comparaison DLSS en bas de page permet aussi de comparer avec et sans ray tracing.

.iframeMultiJuxtapose {width:100%;height:500px;border:0;}Le ray tracing permet de supprimer l’effet artificiel de l’éclairage local de l’intérieur des bâtiments. Ici, la seule lumière provient de la fenêtre à gauche, il n’y a pas de raison qu’elle se diffuse partout dans le couloir à droite. Reste que, certes, on pourra remarquer qu’avec le ray tracing, “on ne voit plus rien” !

.iframeMultiJuxtapose {width:100%;height:500px;border:0;}La différence entre le ray tracing en mode High et Ultra est presque imperceptible. La différence de performances aussi d’ailleurs. Il faudra zoomer dans les deux comparaisons ci-dessus pour se rendre compte que le RT Ultra semble appliquer un filtre de débruitage qui préserve mieux certains détails. En pratique, l’oeil nu ne verra rien dans la plupart des cas.

DLSS : à améliorer en urgence

La qualité du rendu en DLSS est assez décevante par rapport à ce qu’on avait pu voir auparavant, notamment pour Final Fantasy XV et surtout pour 3DMark Port Royal. Cependant, ces deux tests étaient effectués sur des scènes toujours identiques, presque trop facile pour le DLSS. Ici, le DLSS n’en est qu’à ses débuts, et il se pourrait que le Deep Learning améliore les choses avec le temps, notamment pour se débarrasser de cet effet de flou clairement trop prononcé.

.iframeMultiJuxtapose {width:100%;height:500px;border:0;}

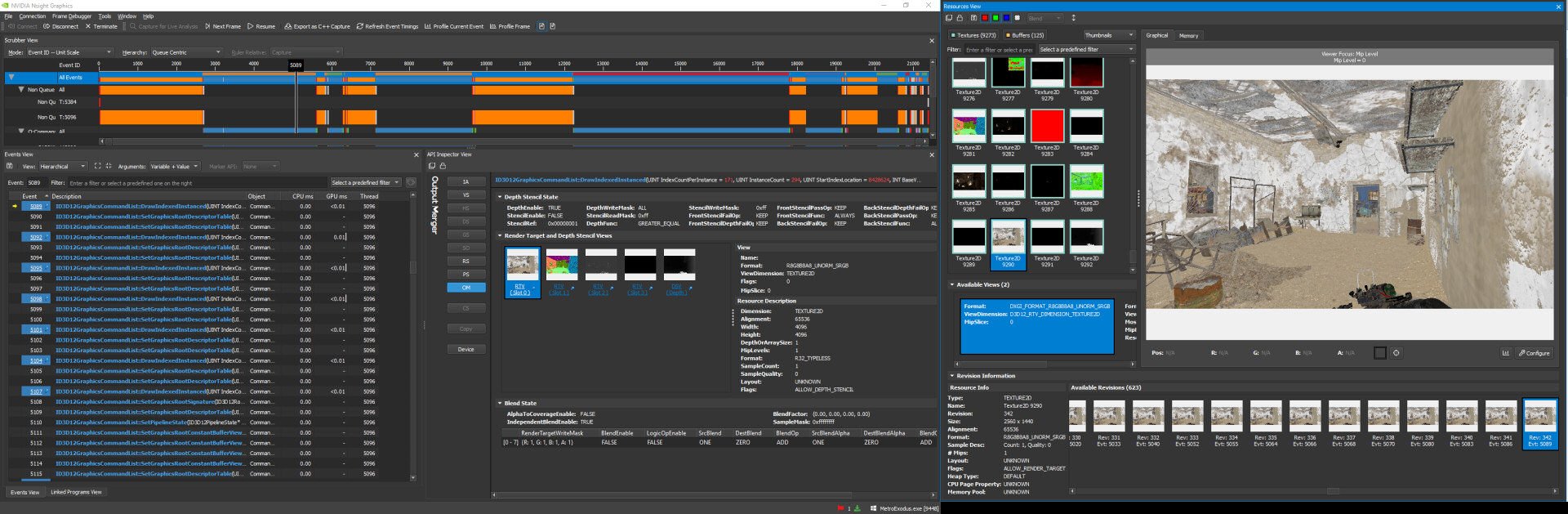

Nous avons de nouveau utilisé NVIDIA nSight pour en avoir le coeur net : le DLSS applique encore bien un upscaling, mais avec des rapports légèrement différents cette fois :

- 2160p (UHD) : 2560 x 1440 *150%

- 1440p (QHD) : 1920 x 1080 *150%

- 1080p (FHD) : 1440 x 810 *133%

- 720p (HD) : 960 x 540 *133%

Notez d’ailleurs que le 720p DLSS n’est absolument pas censé être proposé par le jeu. Il peut s’activer à cause d’un bug de la pré-version du jeu que nous avons testée. Le jeu a d’ailleurs bénéficié d’une mise à jour juste après la rédaction de ce test, tout comme les pilotes GeForce dont les notes de version indiquent des améliorations du DLSS dans ce jeu. Comme le montrent les captures ci-dessous entre “ancien” et “nouveau” DLSS, les différences restent très subtiles, pour ne pas dire invisibles…

NVIDIA GeForce RTX 2080 Ti

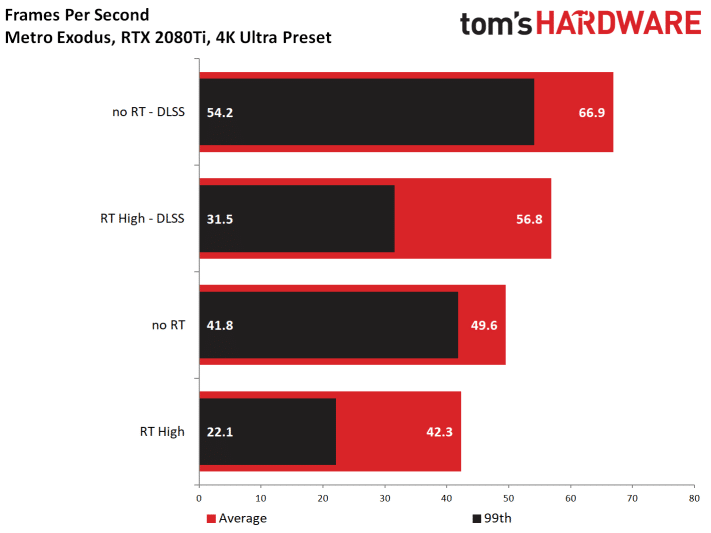

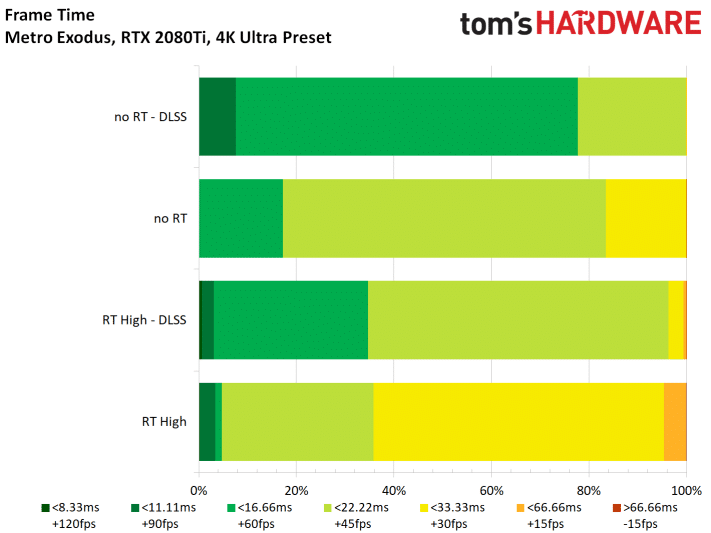

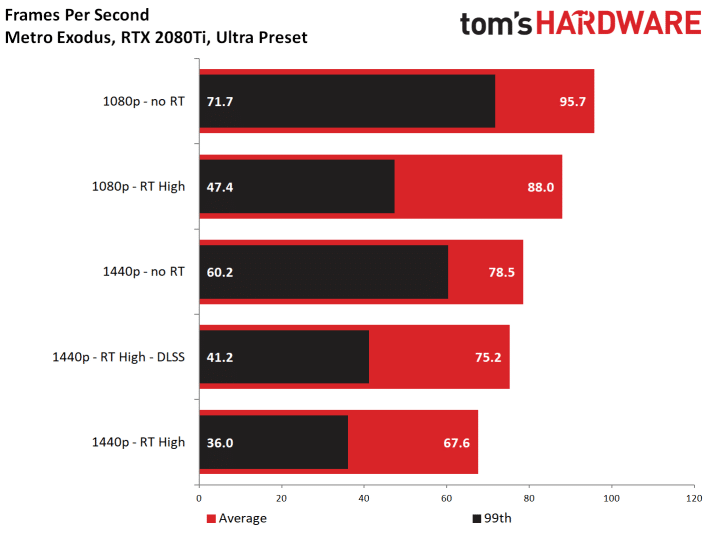

Les réglages recommandés par NVIDIA permettent à la 2080 Ti de viser le jeu en 4K, avec ray tracing et DLSS. Voyons cela de plus près. Sachez que la limite des 60 ips en 4K sans RT que nous avions noté lors de notre preview était due à un bug du moteur du jeu : en passant en mode fenêtré sans bordure, cette limitation disparait…

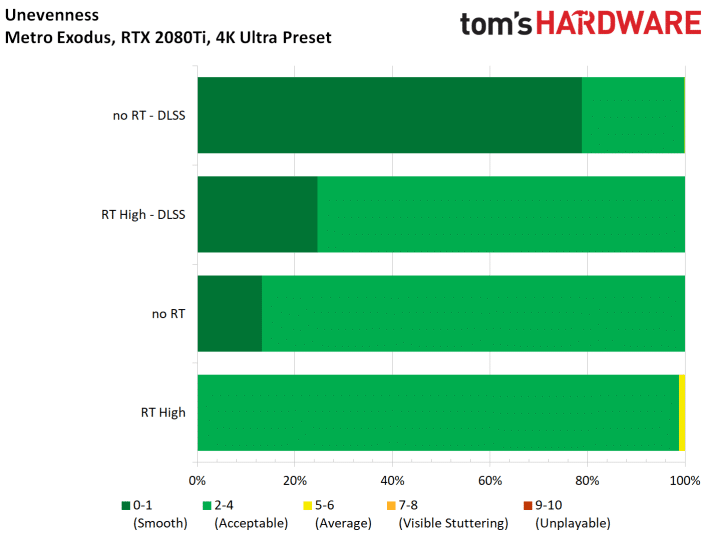

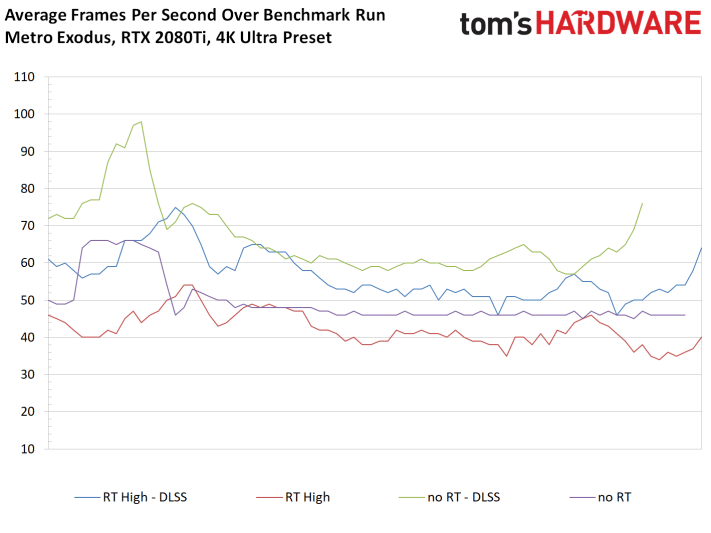

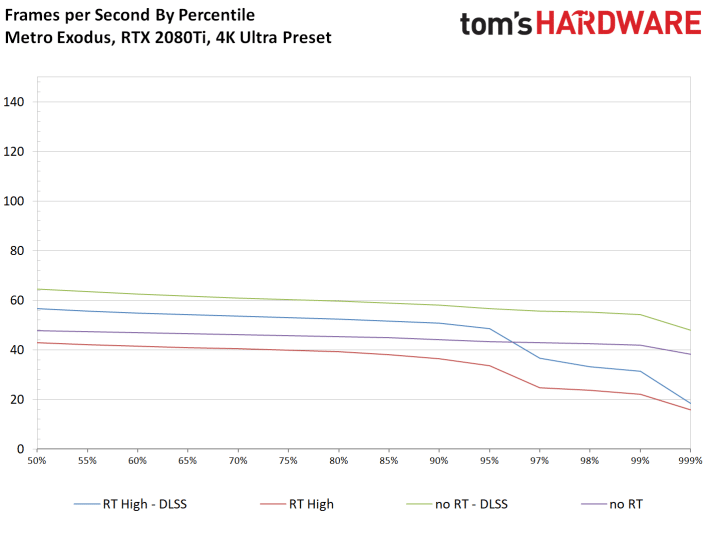

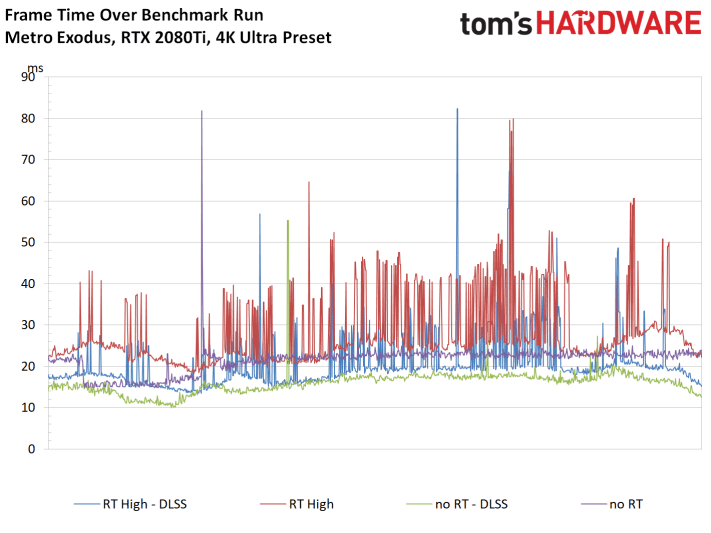

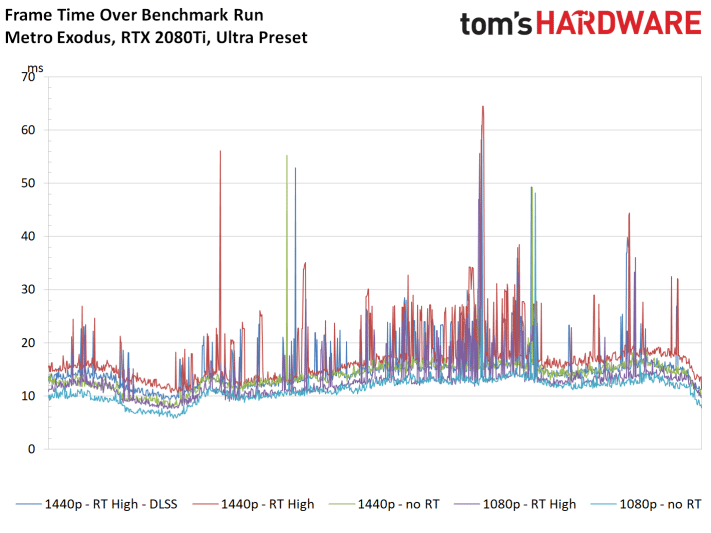

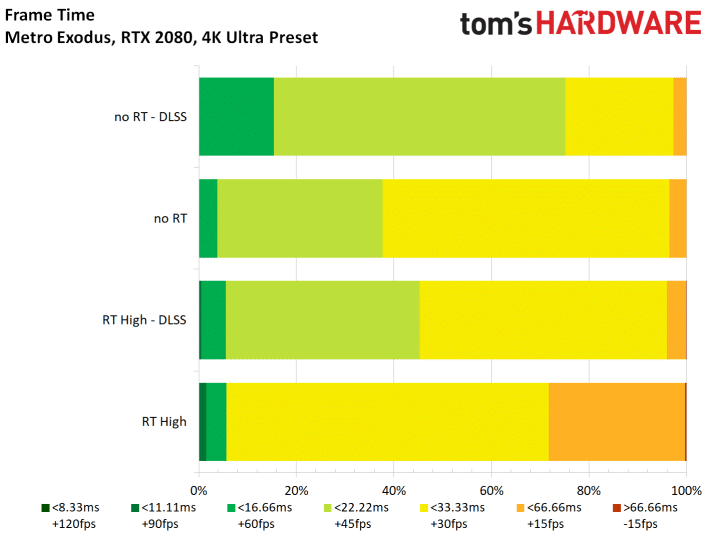

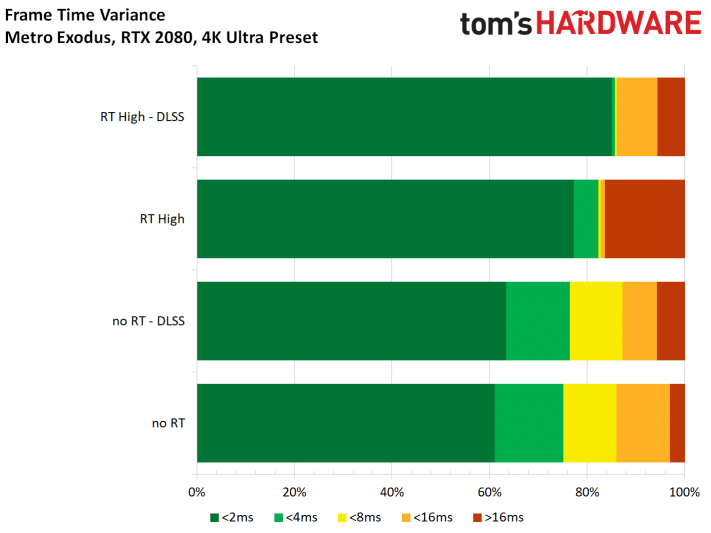

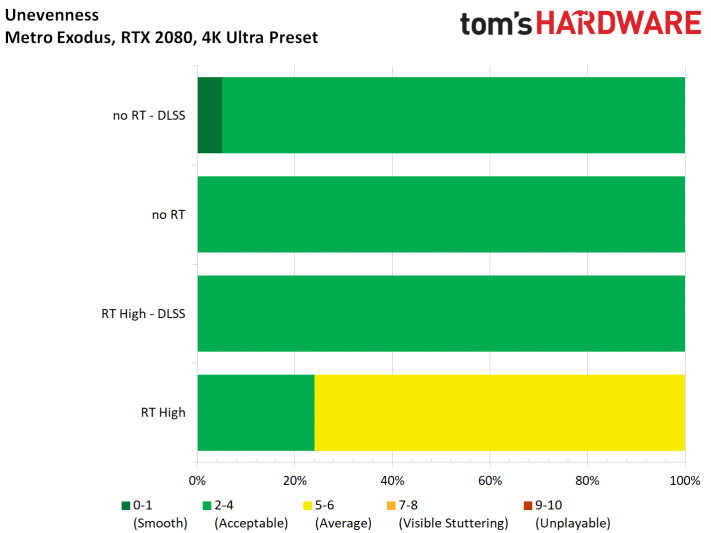

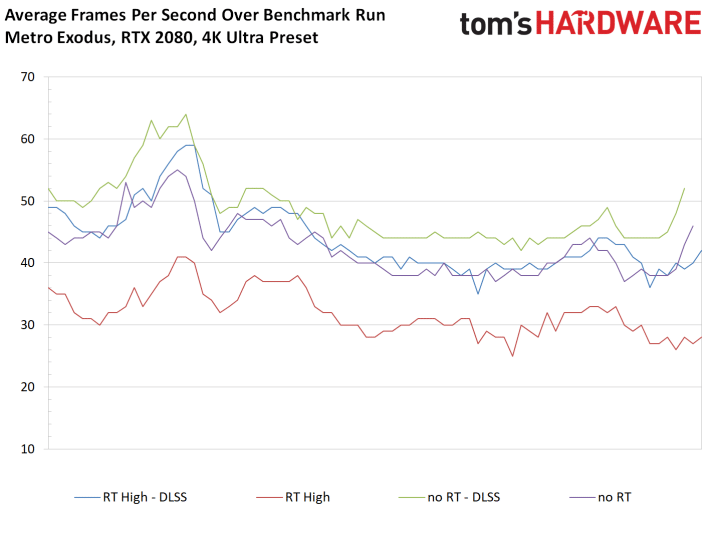

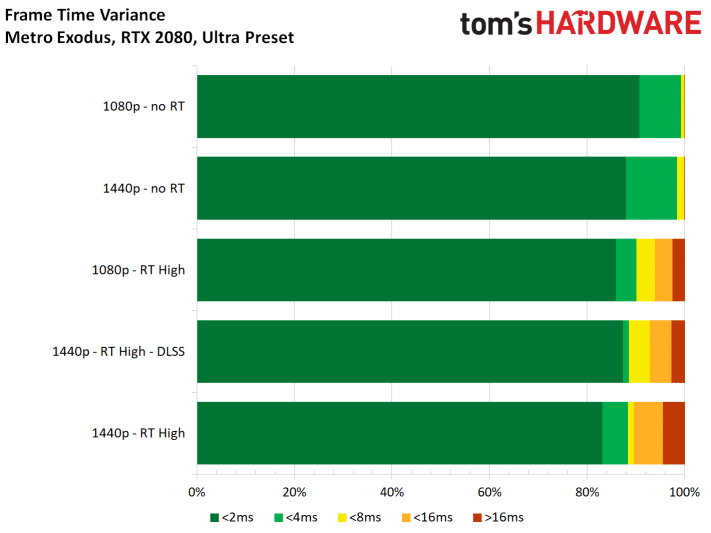

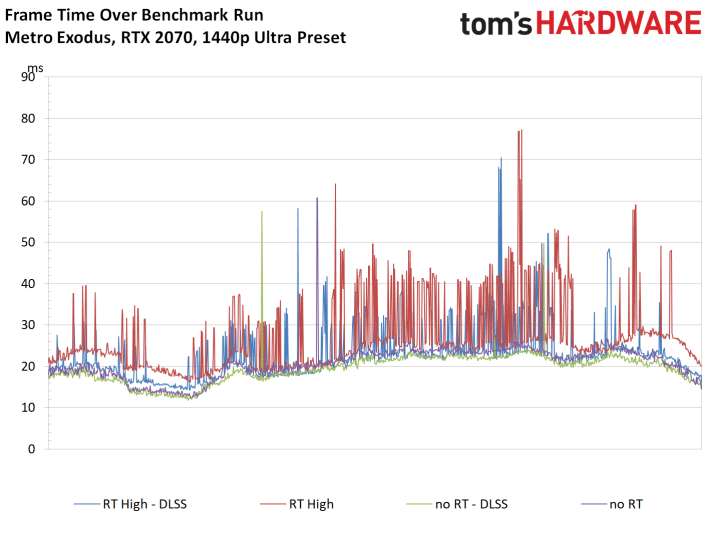

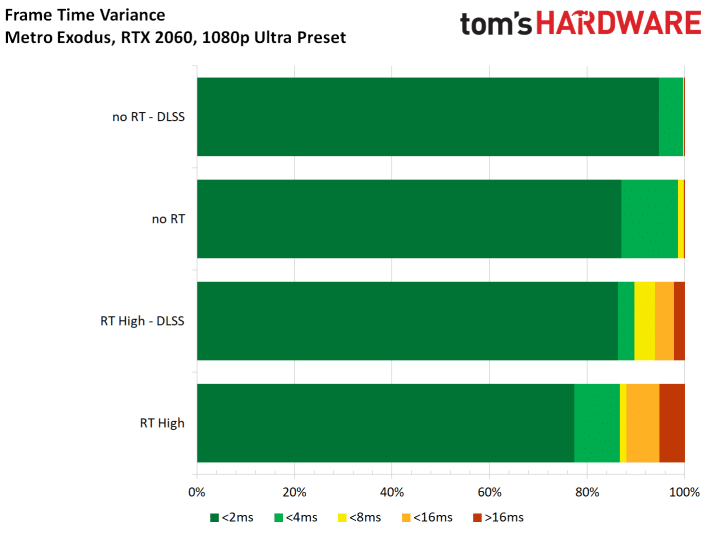

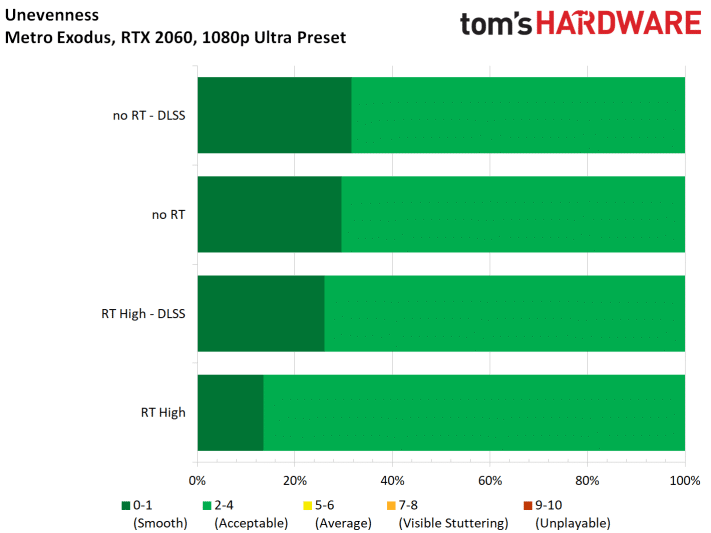

4K

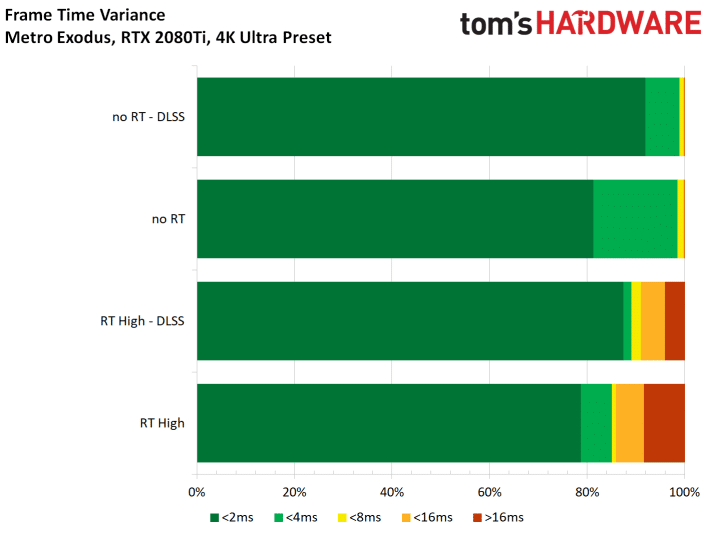

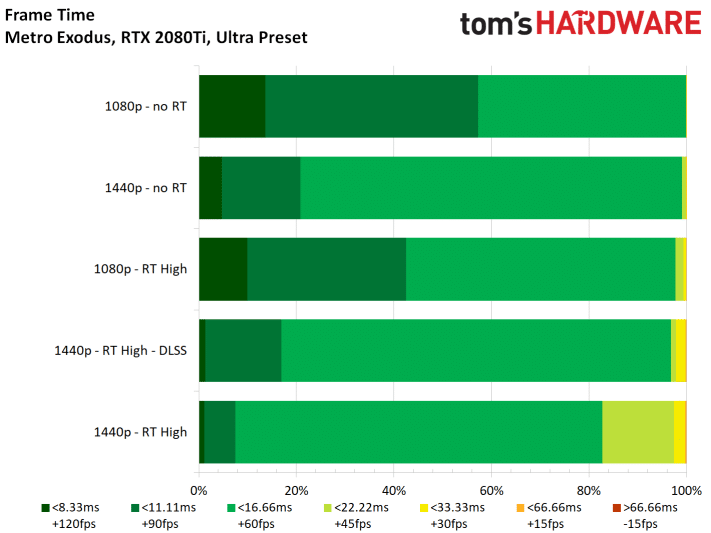

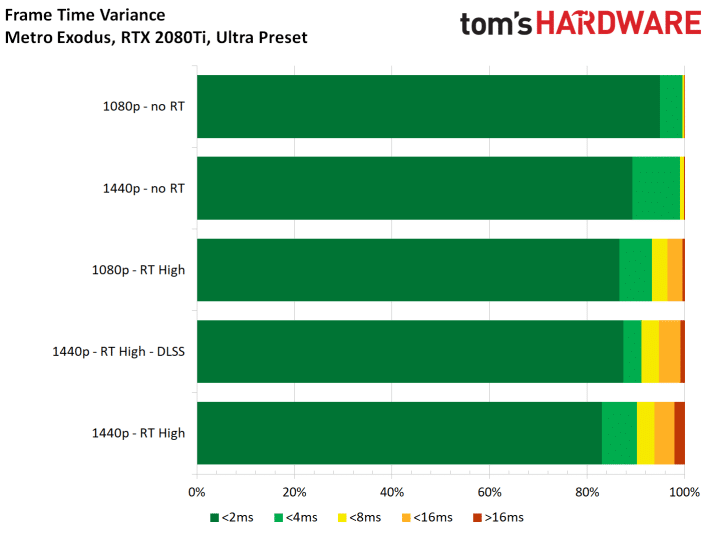

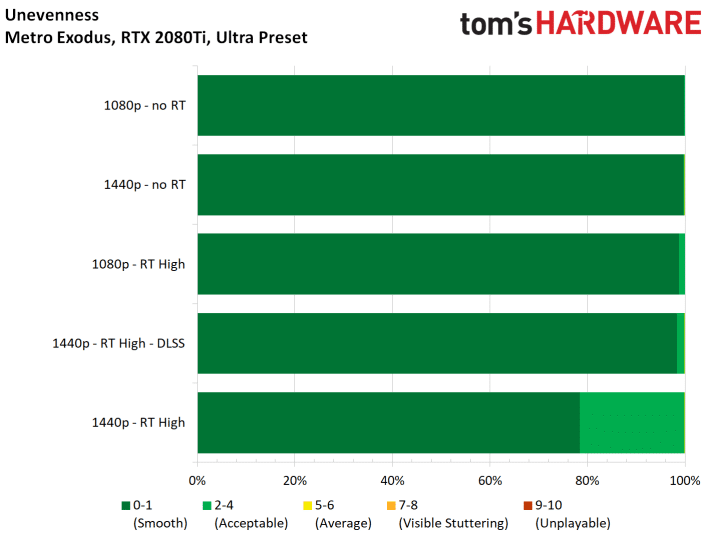

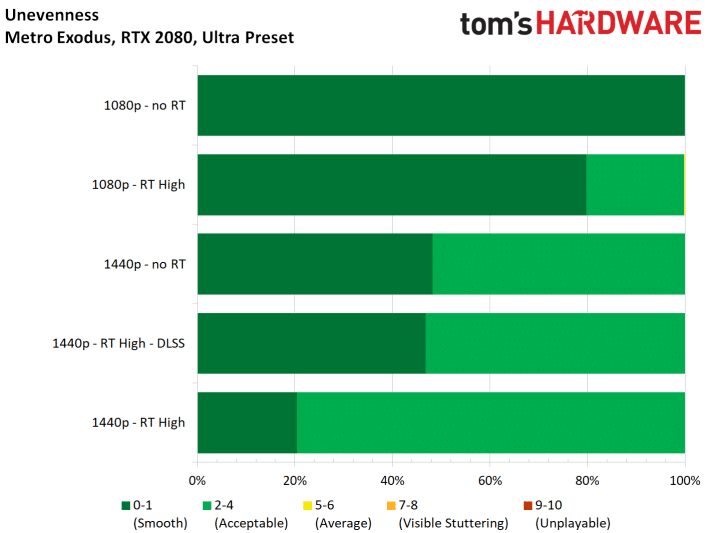

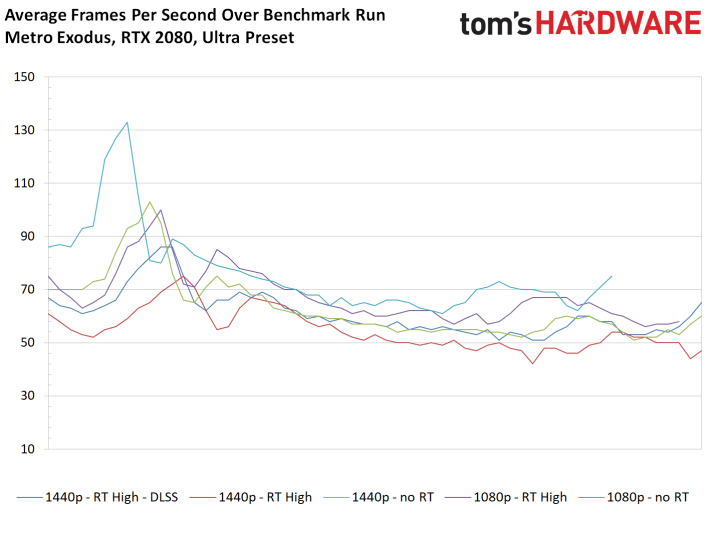

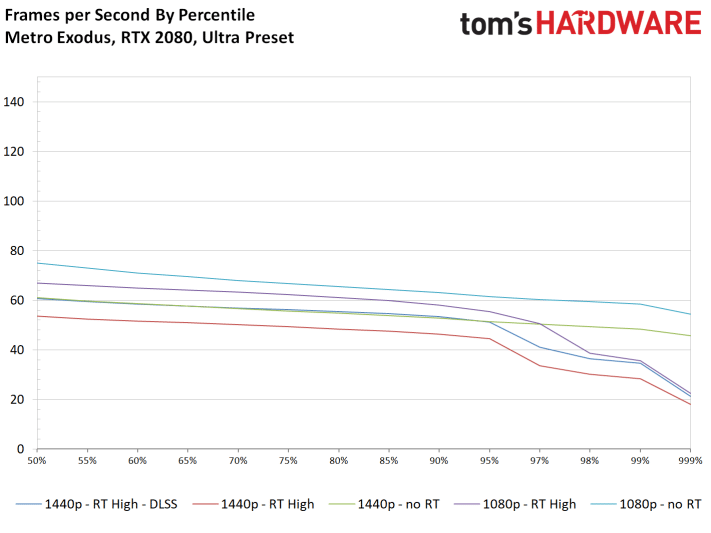

Si le rendu 4K sans ray tracing est aux portes des 50 ips de moyenne, l’activation du DLSS fait grimper le framerate moyen au delà des 60 ips. L’activation du ray tracing fait forcement chuter les performances, en particulier sur les 1% d’images par seconde les plus bas. En moyenne, l’activation du DLSS permet d’améliorer de 25% le framerate moyen. Notons que le ray tracing semble augmenter très sensiblement la variation du temps de rendu des images, ce qui se traduit par de nombreux pics sur le graphique de frame time.

QHD et FHD

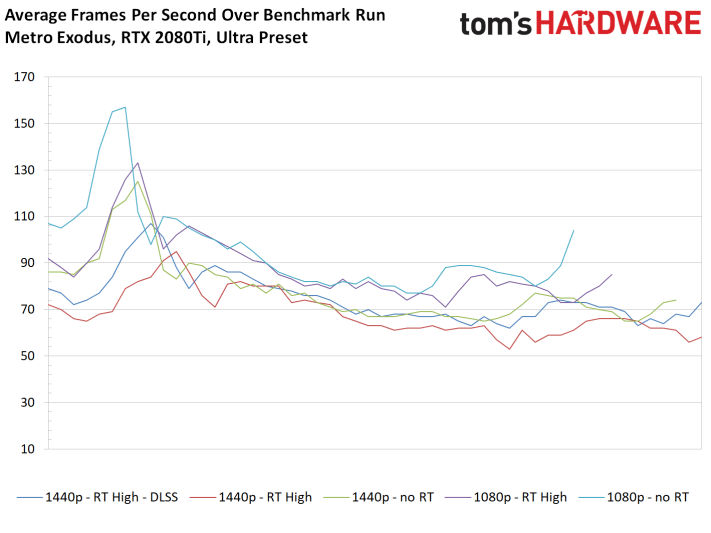

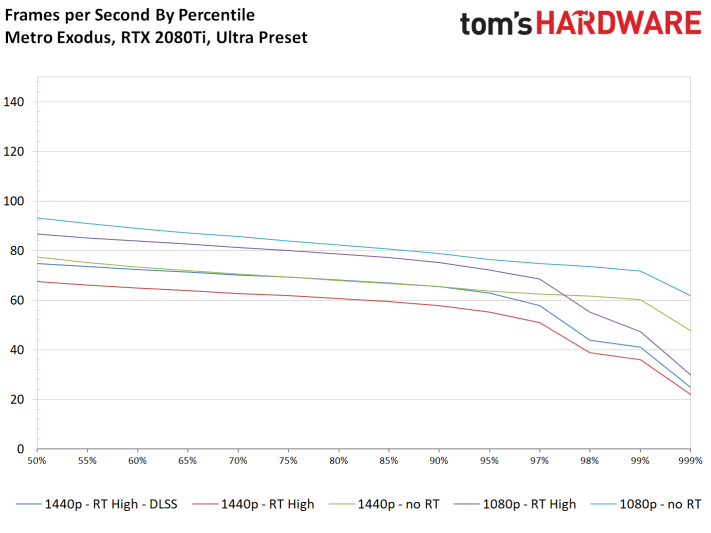

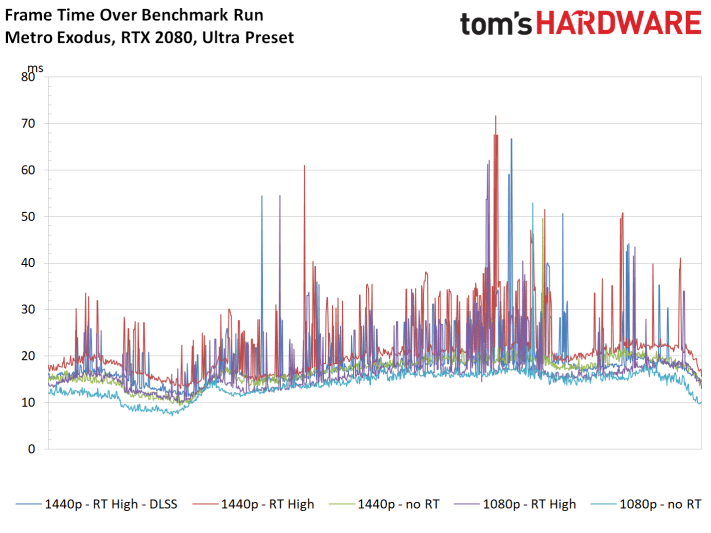

Le passage à des définitions inférieures rend la tâche encore plus facile pour la GeForce RTX 2080 Ti, bien que l’activation du ray tracing entraine toujours une chute du 99ième percentile. En terme de framerate moyen, l’activation du DLSS en QHD permet presque de rattraper la chute causée par le ray tracing. Encore une fois, le ray tracing entraine de nombreuses fluctuations du frame time.

NVIDIA GeForce RTX 2080

La GeForce RTX 2080 vise quant à elle le QHD selon les recommandations de NVIDIA lorsque l’on active le ray tracing et le DLSS. Nous avons toutefois décidé de la tester également en 4K.

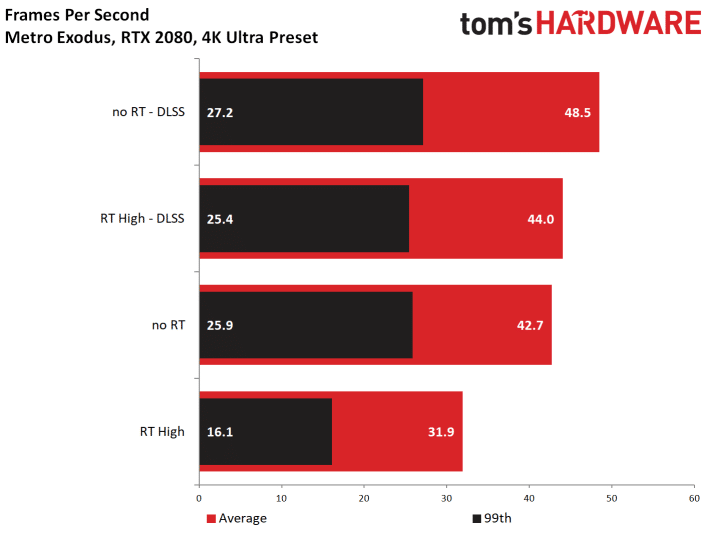

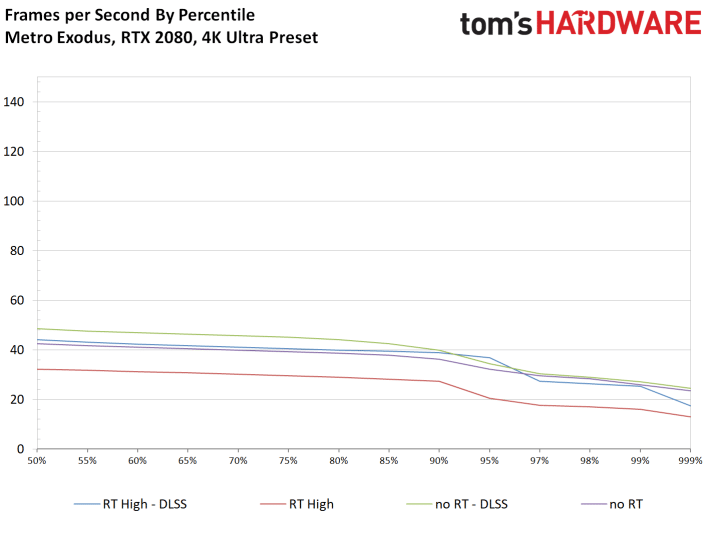

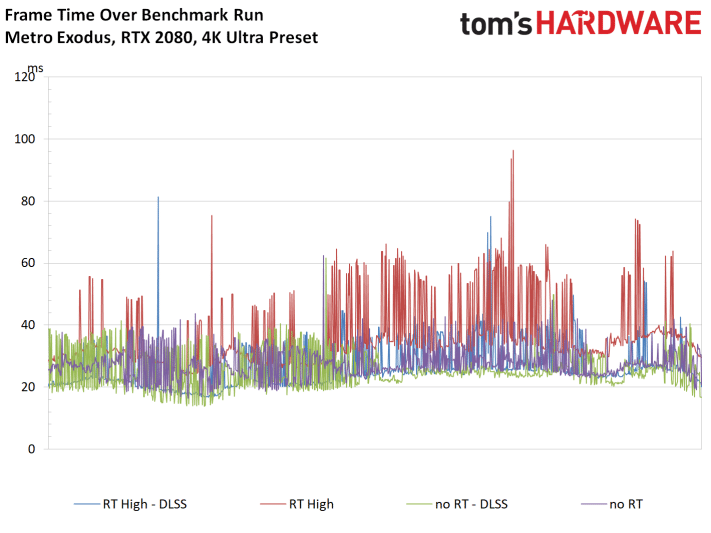

4K

Avec un framerate moyen sous les 50 ips, et des chutes régulières sous les 30 ips, la RTX 2080 n’est effectivement pas assez puissante pour taquiner le 4K de manière agréable, en tout cas avec des réglages graphiques Ultra, et ce même avec le DLSS activé et sans ray tracing. Il faudra donc baisser un peu les réglages graphiques pour jouer dans cette définition. Le temps de rendu des images est ici aussi très fluctuant, mais contrairement à la 2080 Ti, c’est aussi le cas lorsque le ray tracing n’est pas actif.

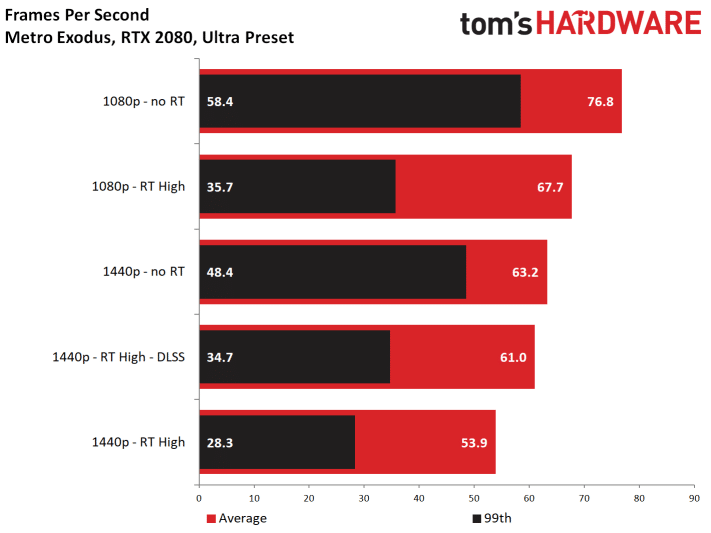

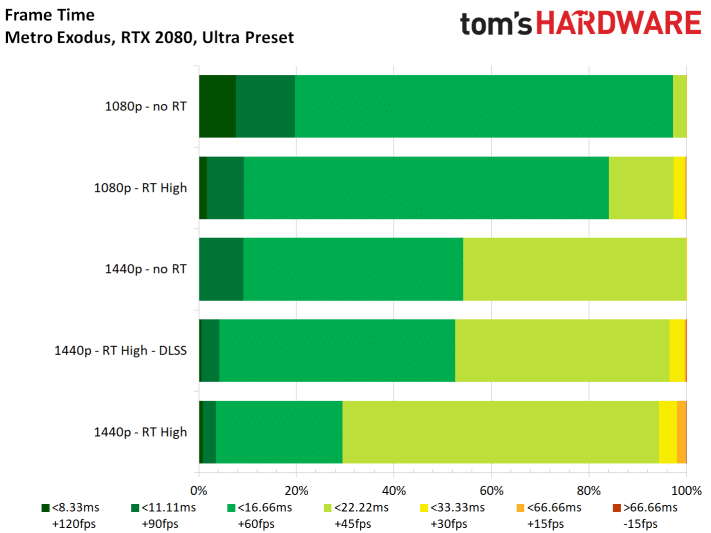

QHD et FHD

La GeForce RTX 2080 s’en sort forcément mieux en QHD, et encore plus en FHD. Le framerate moyen dépasse dans tous les cas les 60 ips, sauf en QHD avec ray tracing (mais sans DLSS) où elle franchit tout de même la barre des 50 ips, mais avec un 99ième percentile sous les 30 ips. Ici aussi, l’activation du DLSS permet de gommer presque entièrement la perte causée par l’utilisation du ray tracing. Une fois n’est pas coutume, le temps de rendu des images souffre de fortes variations lorsque le ray tracing est activé.

NVIDIA GeForce RTX 2070

Les réglages conseillés par NVIDIA pour la RTX 2070 visent le Full HD avec des réglages graphiques Ultra, le tout avec le ray tracing et le DLSS activés. Nous avons quand même voulu savoir comment cette carte s’en sortait en QHD également.

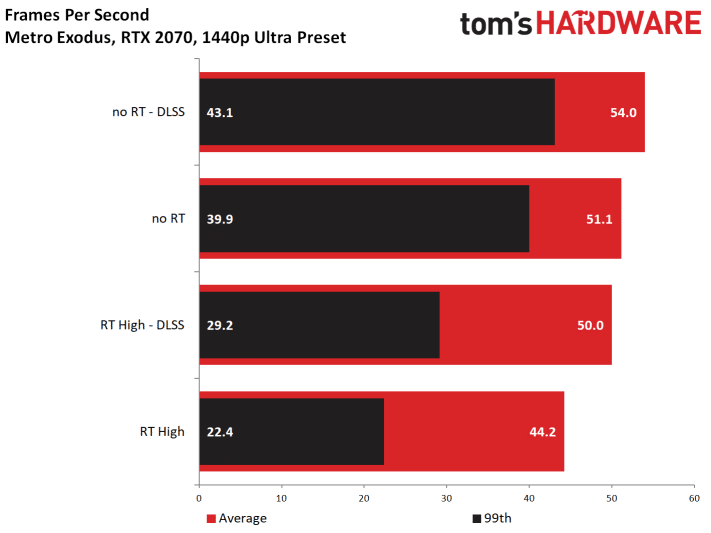

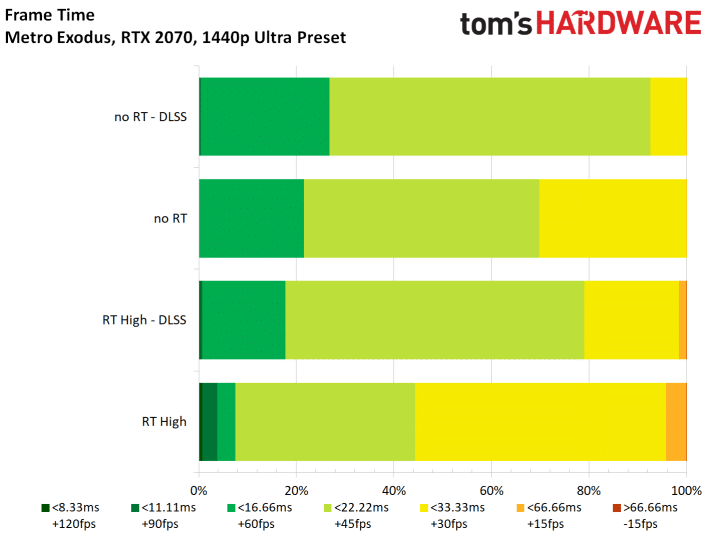

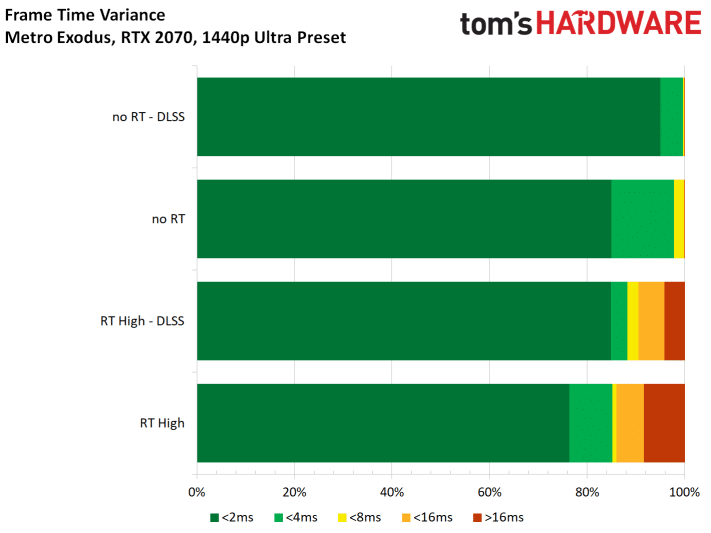

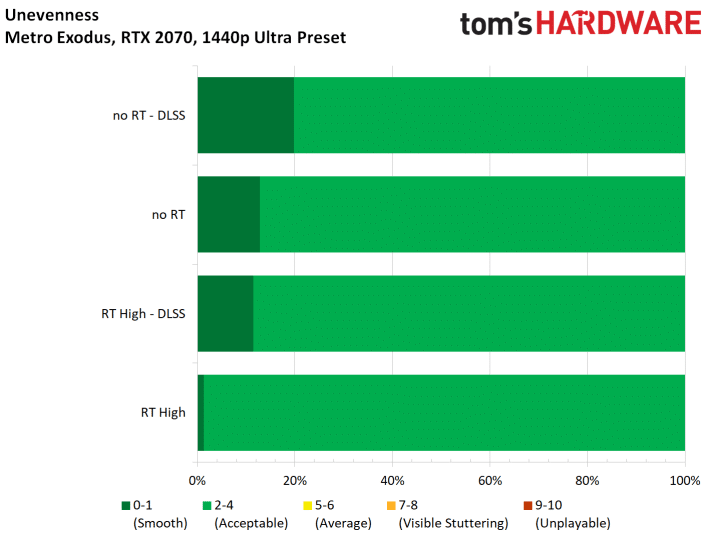

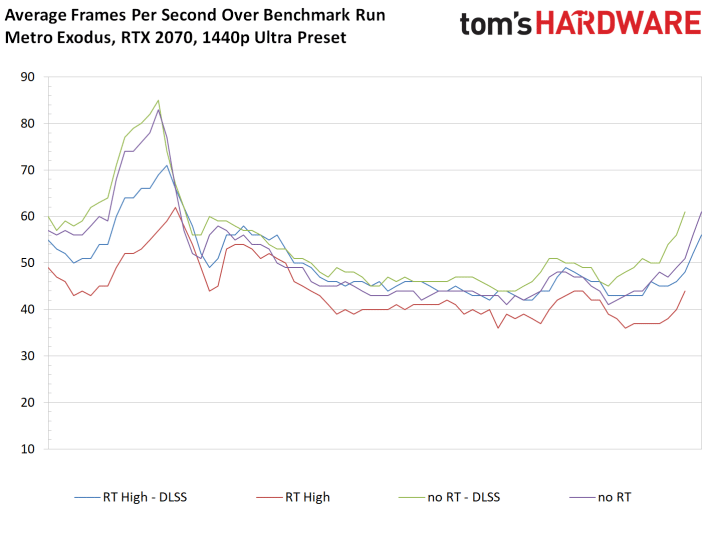

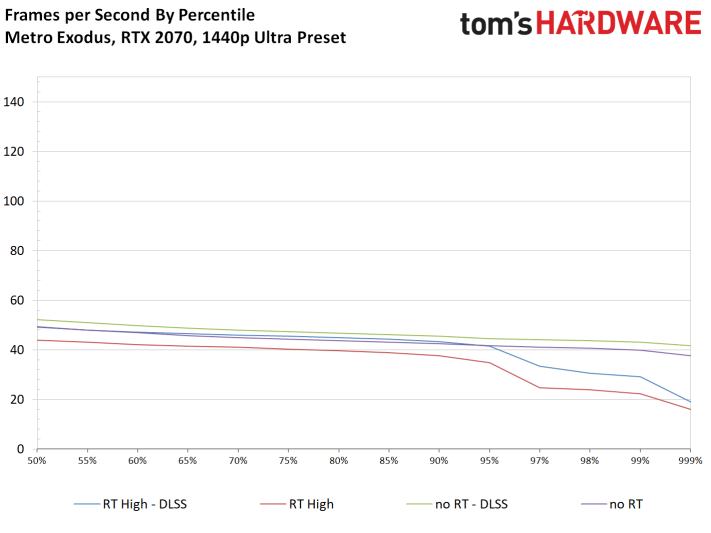

QHD

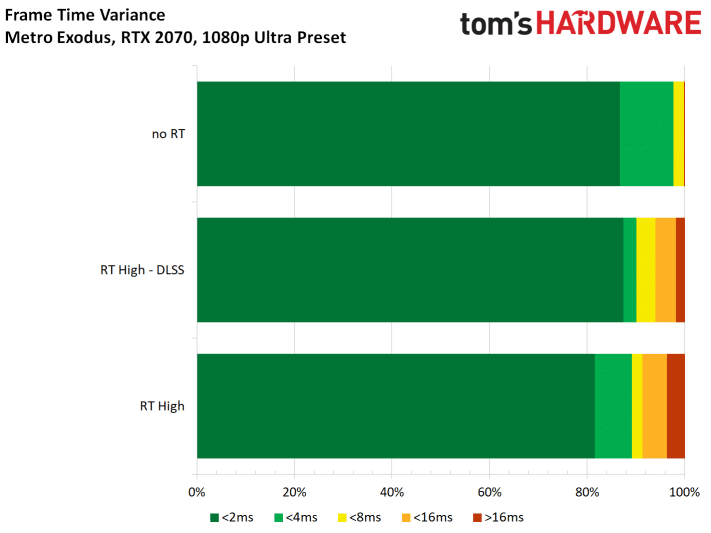

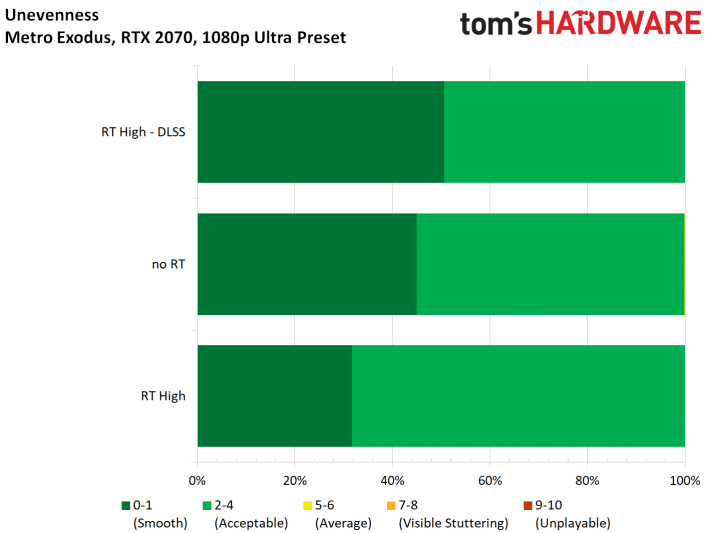

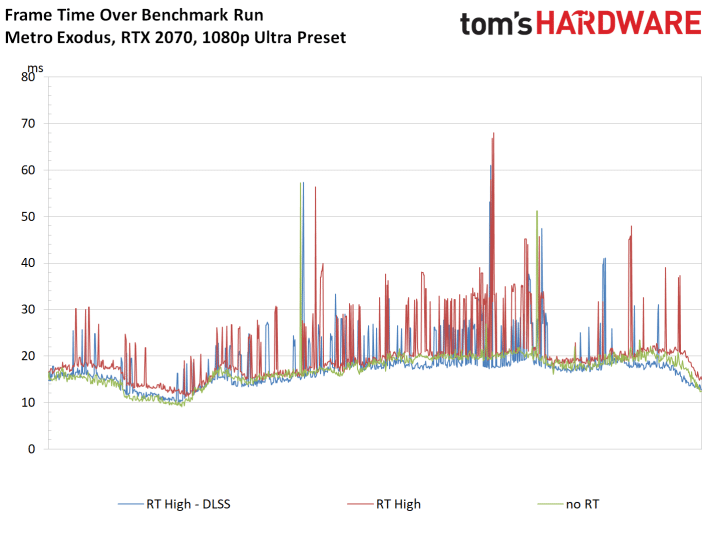

Sans ray tracing, la RTX 2070 parvient à maintenir un framerate moyen au dessus des 50 ips. Elle dépasse également cette barre avec ray tracing, pourvu que le DLSS soit également actif. Le 99th percentile devient toutefois dans ce cas très limite, avec quelques chutes sous les 30 ips. Dans l’absolu, il reste possible de jouer en QHD avec cette carte graphique. Une légère diminution des détails graphiques pourra améliorer les choses. Comme pour les 2080 et 2080 Ti, la 2070 souffre de grosses variations dans le temps de rendu des images lorsque le ray tracing est activé, en particulier lorsque le DLSS n’est pas présent.

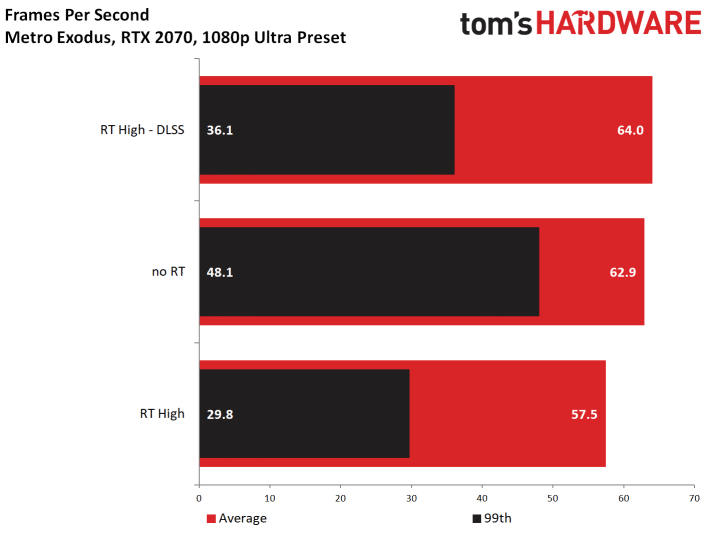

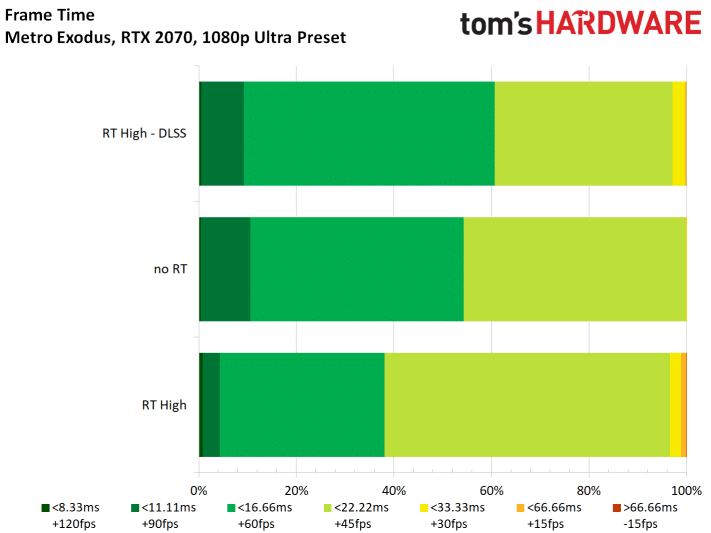

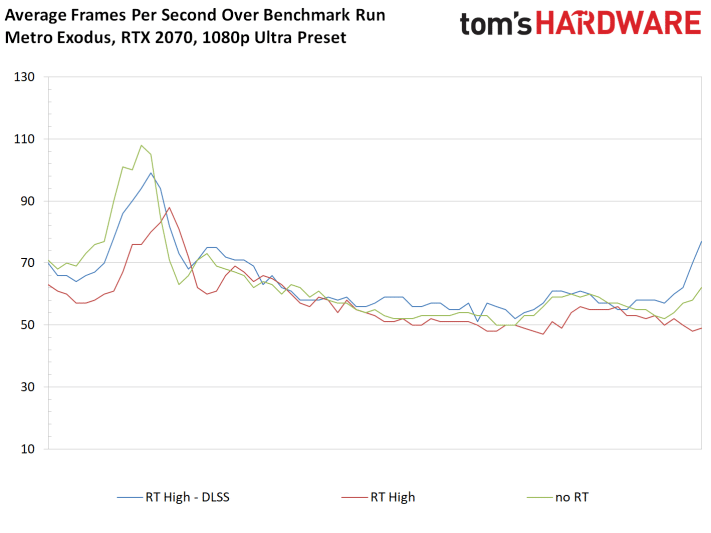

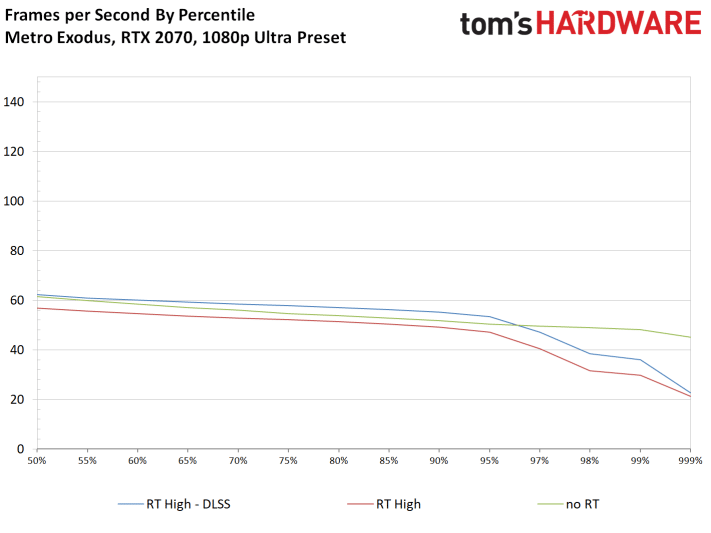

FHD

En Full HD, la RTX 2070 respire un peu plus, avec un framerate dépassant les 60 ips sans ray tracing ou avec ray tracing et DLSS. Seul le ray tracing “seul” passe sous cette barre, mais reste au delà des 50 ips. Le fluidité reste acceptable dans tous les cas. Une nouvelle fois, on notera de grosses fluctuations au niveau des frame time avec le ray tracing actif.

NVIDIA GeForce RTX 2060

Dernière de la petite famille RTX, la 2060 est taillée pour du Full HD. Nous avons toute de même voulu savoir si elle arrivait aussi à s’en sortir en QHD.

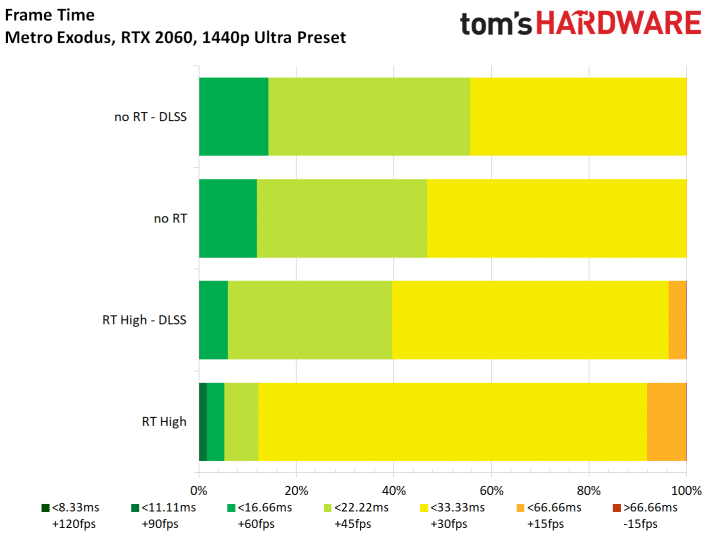

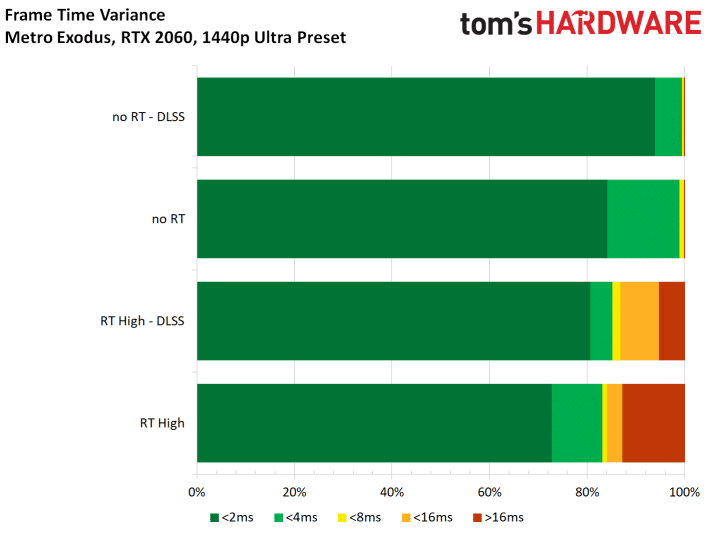

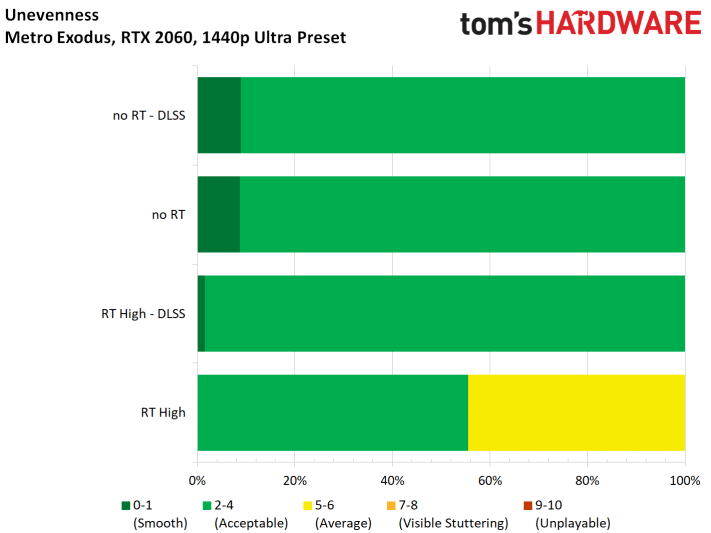

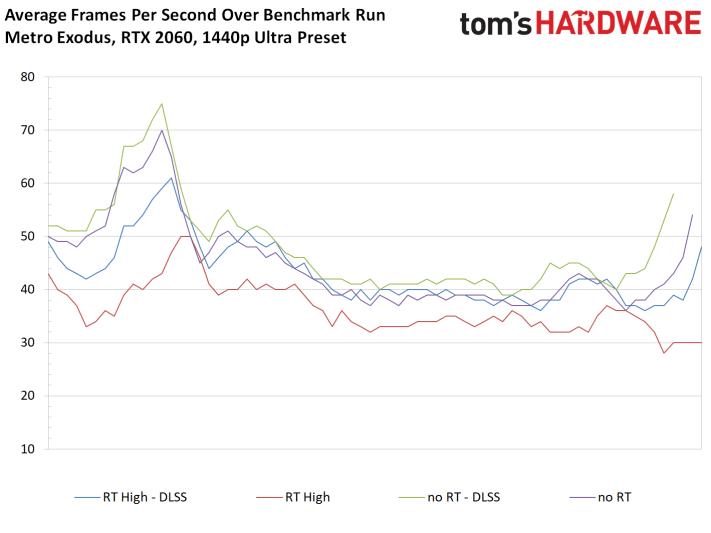

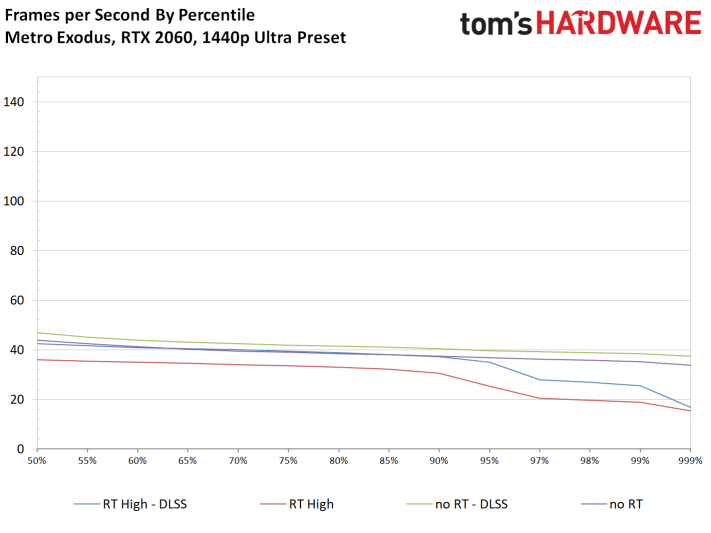

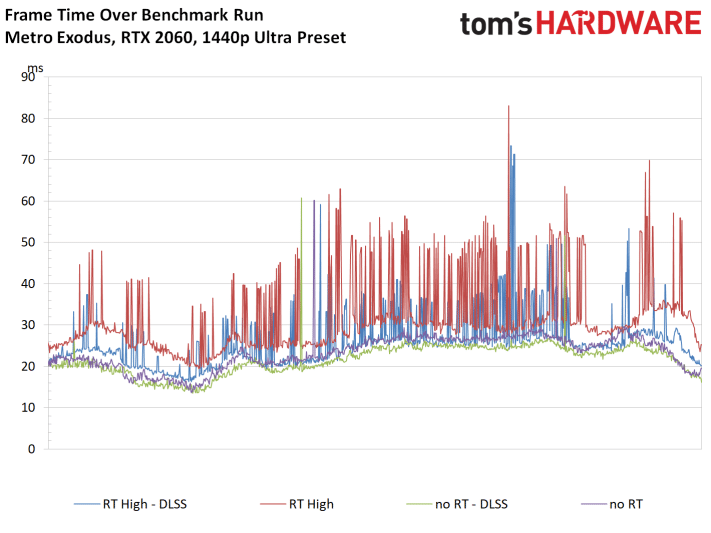

QHD

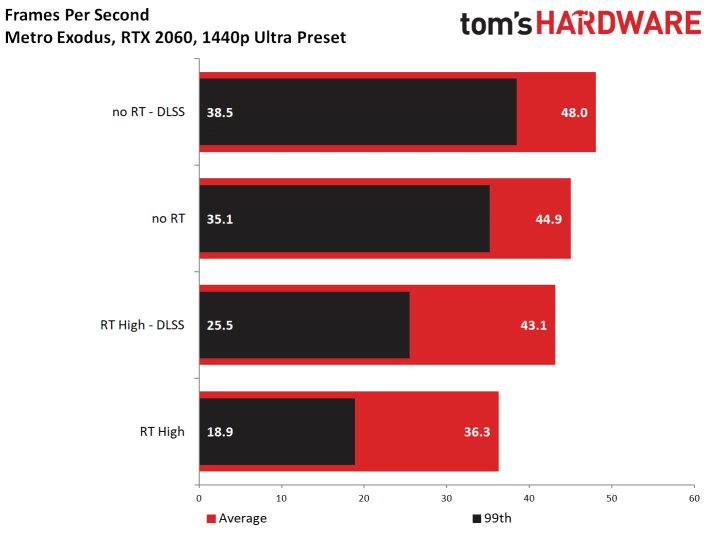

Pas de surprise, la RTX 2060 a du mal avec le 1440p puisque même sans RT et avec DLSS elle ne franchit pas les 50 ips en moyenne. Le ray tracing est tout simplement injouable dans cette définition, et on notera que les frame time souffrent avec cette technologie de la même variabilité que sur les autres cartes.

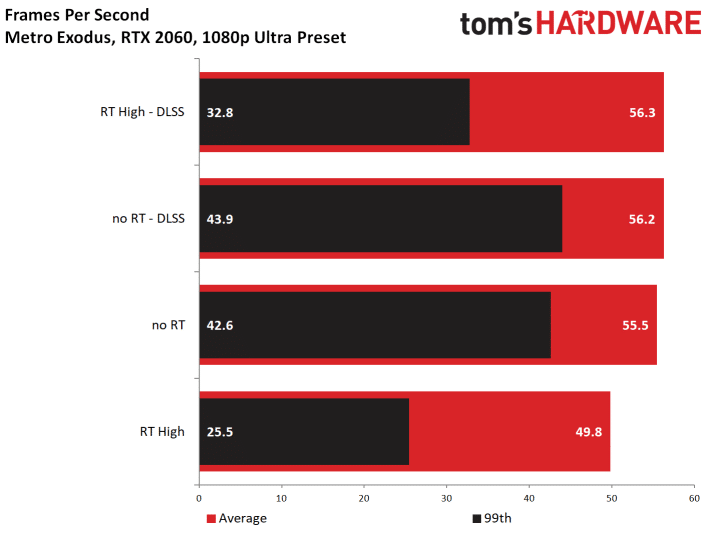

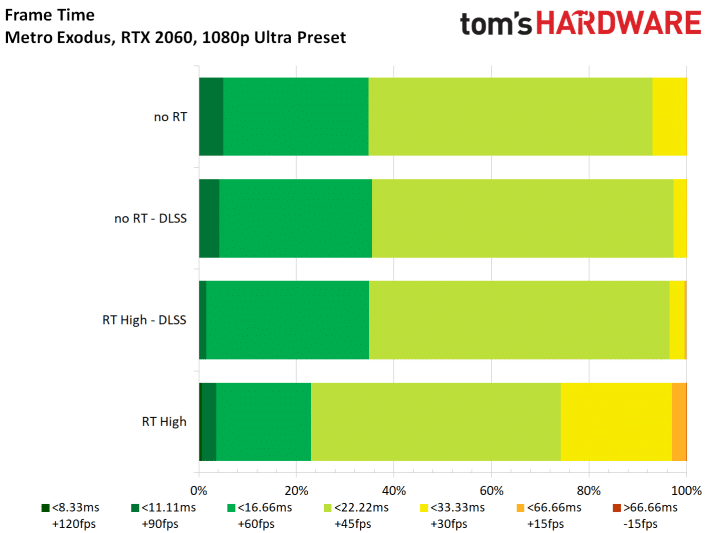

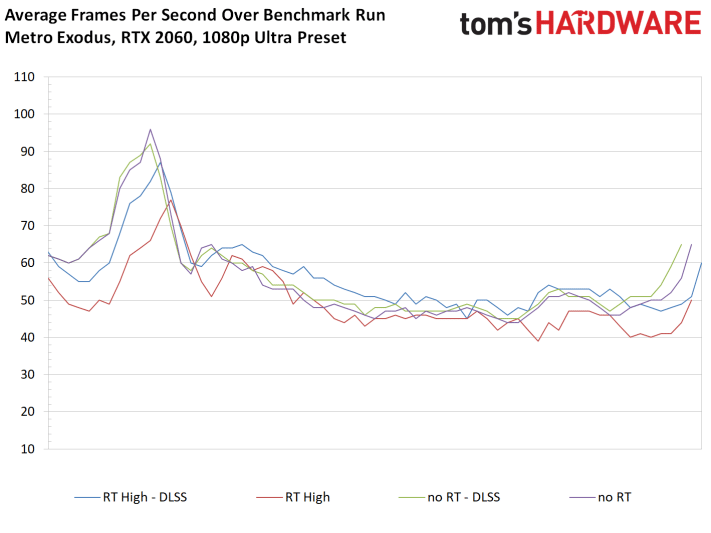

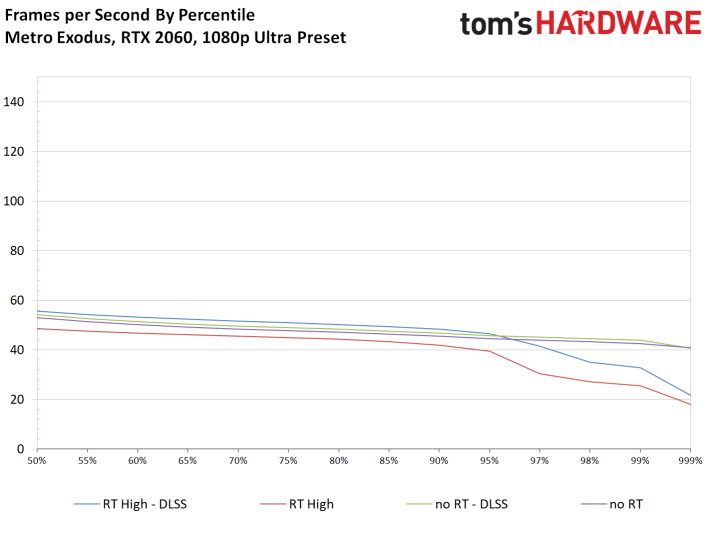

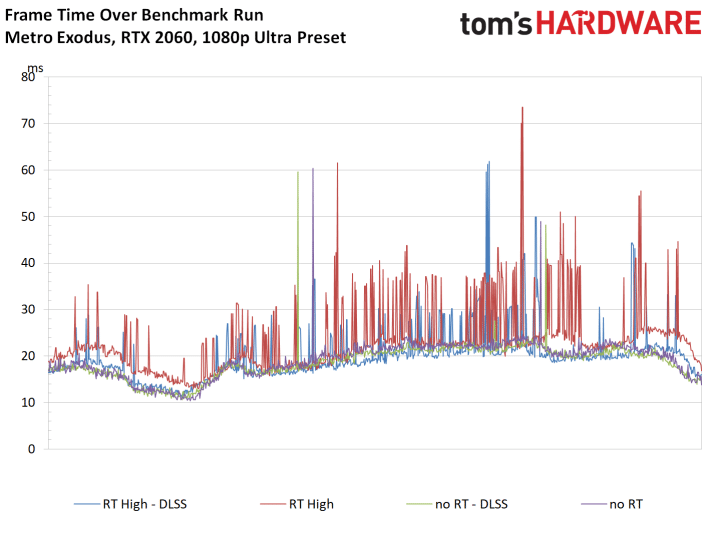

FHD

C’est mieux en Full HD, mais les résultats proches sans ray tracing, sans ray tracing avec DLSS et avec ray tracing et DLSS laissent supposer que ce sont les autres étapes de rendu qui sont ici le facteur limitant. Autrement dit, le niveau de détails Ultra est probablement trop élevé pour cette petite GeForce RTX, même en Full HD. La barre des 50 ips de moyenne est tout de même franchie (sauf avec ray tracing seul). Enfin, on note encore une fois la grande variabilité dans le temps de rendu des images lorsque le ray tracing est activé.

Quelle carte pour jouer à 60 ips ?

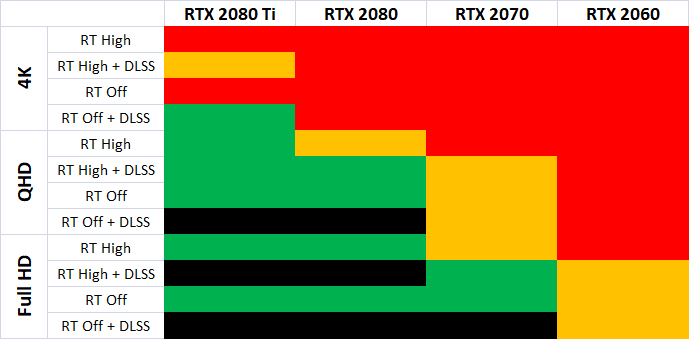

Si vous cherchez la carte idéale pour obtenir un framerate moyen de 60 ips suivant tel ou tel réglage, le tableau suivant devrait faire votre bonheur : nous y avons synthétisé les framerate moyen des différentes cartes en 4K, QHD et FHD. En vert, le taux moyen d’images par seconde dépasse les 60 ips, en orange il se situe entre 50 et 60 ips et en rouge il est inférieur à 50 ips. Enfin, on trouve en noir les combinaisons impossibles.

Seule la RTX 2080 Ti est capable de jouer en 4K de manière convenable, sans ray tracing voire avec ray tracing en se contentant d’un framerate moyen entre 50 et 60 ips. Le DLSS reste toutefois nécessaire pour éviter que le nombre d’images par seconde ne chute trop. La RTX 2080 est quant à elle parfaitement adaptée à la définition QHD, avec ou sans ray tracing.

La RTX 2070 se sentira à l’aise en Full HD, même si une petite incursion en QHD reste possible, sous réserve de se contenter d’un framerate juste supérieur à 50 ips. Enfin, la RTX 2060 aura du mal même en Full HD, il faudra probablement jouer avec des détails graphiques un peu plus faibles que le réglage Ultra.

Ressources CPU, RAM, VRAM

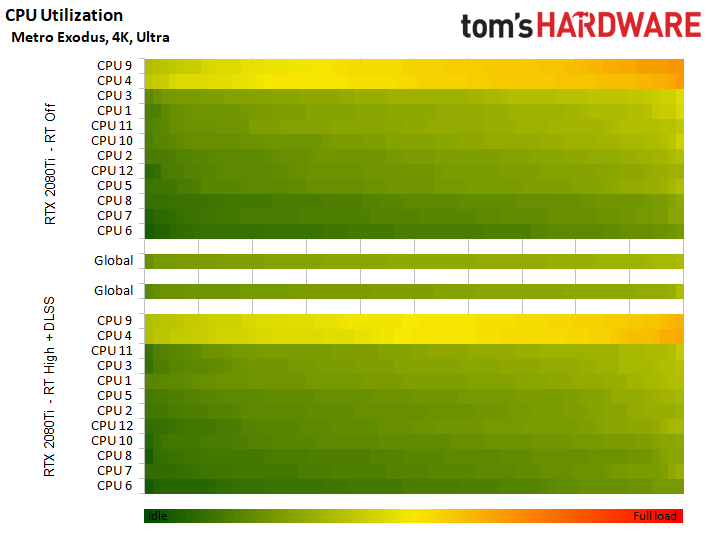

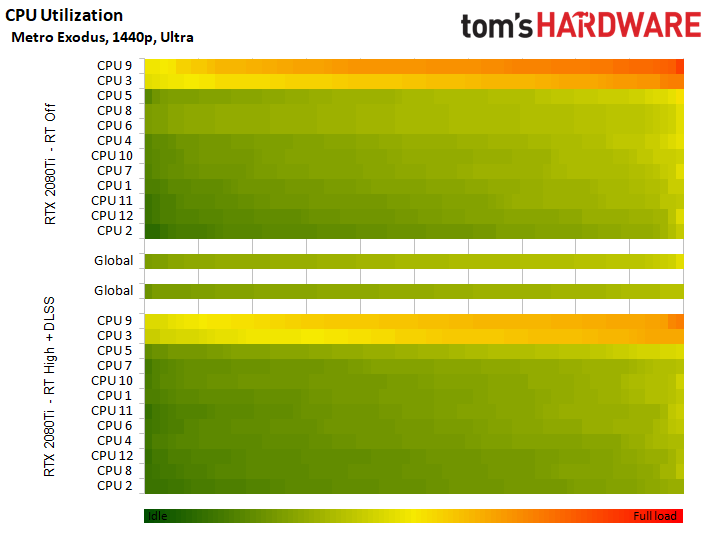

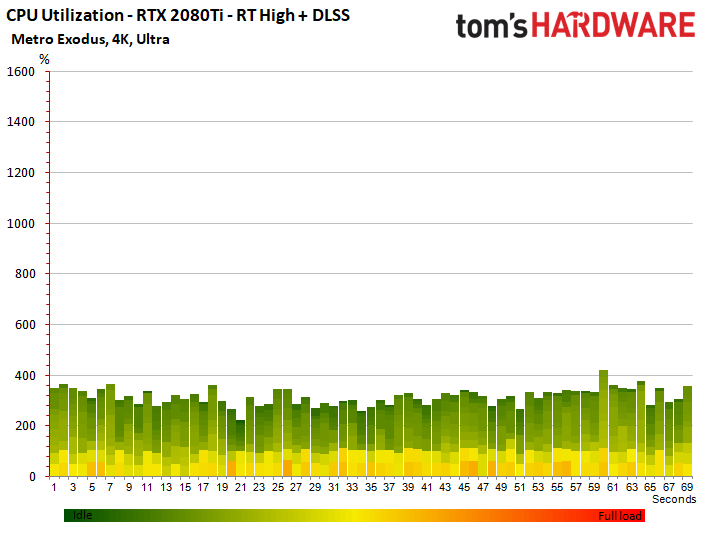

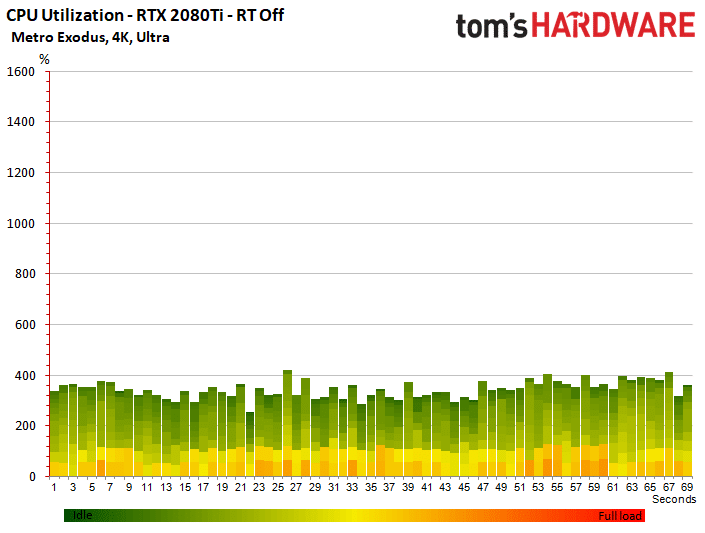

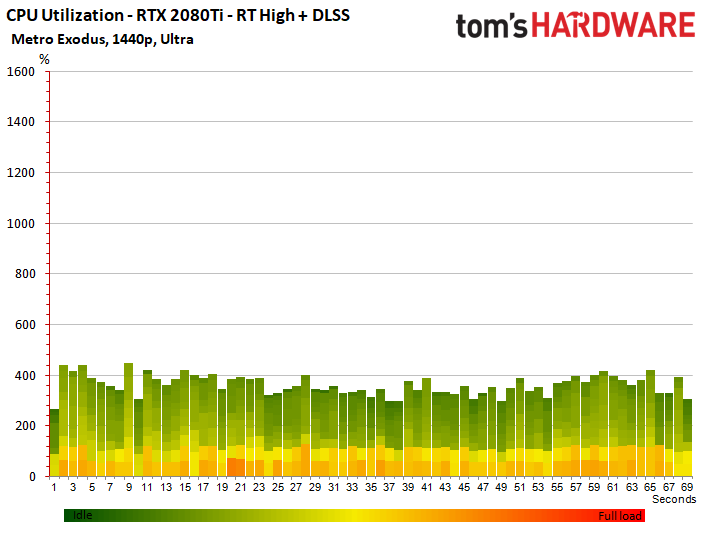

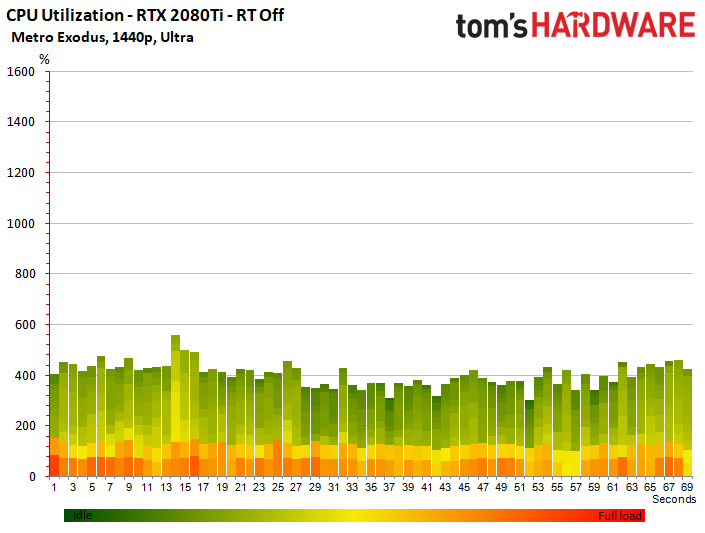

Voyons maintenant comment Metro Exodus gère les ressources CPU et RAM à sa disposition. La configuration “Ultra” demande un Core i7-8700 et 16 Go de mémoire vive, cela tombe bien puisque c’est exactement notre configuration. Nous avons testé avec l’HyperThreading activé et en DirectX 12, le tout en QHD et 4K avec les mêmes réglages que précédemment.

Processeur

L’occupation CPU globale augmente bien entendu au fur et à mesure que l’on descend en définition, mais on remarque surtout que deux threads seulement sont particulièrement chargés. Le reste des coeurs est légèrement occupé, entre 10% et 30% en moyenne. Le moteur de Metro Exodus a donc un embryon de gestion multithreading puisqu’il est capable d’utiliser tous les vCPU de notre processeur, mais il a encore du mal a équilibrer cette charge au delà des deux threads principaux.

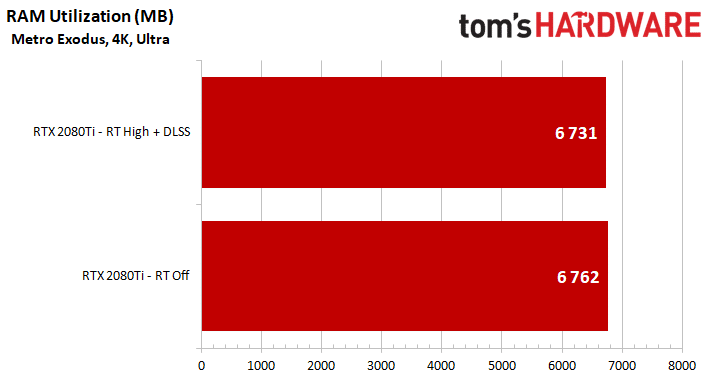

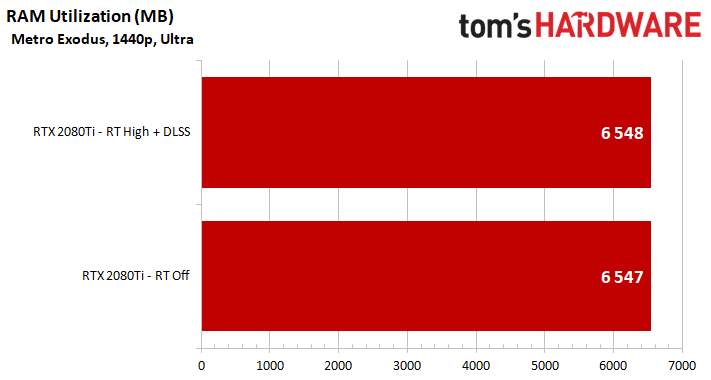

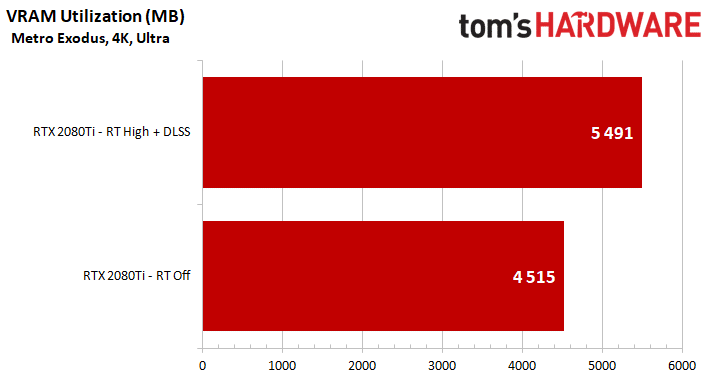

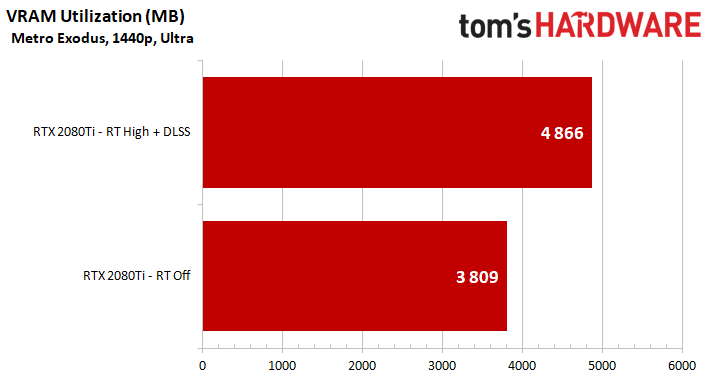

RAM et VRAM

Metrox Exodus consomme légèrement plus de mémoire vive en 4K par rapport au 1440p, ce qui n’est absolument pas anormal. L’activation du ray tracing et du DLSS n’entraine par ailleurs aucune consommation de RAM supplémentaire.

Côté VRAM, c’est différent : l’activation du ray tracing et du DLSS fait gonfler l’occupation de 1 Go environ.

Conclusion

Exceptionnellement pour ce jeu, nous avons tenté de fournir un test complet des technos RTX et DLSS en démarrant les tests avant la sortie officielle. Habituellement, nous attendons le lancement, les premiers patchs et les pilotes officiels pour fournir des chiffres plus fiables. Et pour Metro Exodus, un premier patch est sorti il y a quelques heures déjà… Le DLSS reste inchangé, mais on ne peut rien garantir pour les performances. Pour les prochains titres nous feront comme avant, sans céder à la course à la publication…

Techniquement, Metro Exodus s’impose comme l’un des jeux les plus exigeants en puissance GPU pour ce début d’année 2019. Avec les technologies RTX, et même avec l’aide du DLSS, la RTX 2060 se retrouve en échec, même en Full HD, incapable de fournir un gameplay suffisamment fluide. Cette carte est pourtant capable de faire tourner Battlefield V correctement avec ray tracing.

Il est fort possible que les performance de Metro Exodus s’améliorent avec le temps. Le jeu est sorti sans les dernières finitions (comme les autres), et une marge d’optimisation est certainement possible, surtout qu’il faut aussi être indulgent : les technos RTX débutent, les développeurs essayent encore de les apprivoiser correctement, c’est un travail complexe qui prend du temps. Si on peut effectivement considérer que l’heure est à “l’essuyage de plâtre”, nous persistons à croire que ce rendu hybride avec ray tracing est promis à un bel avenir, tout comme le DLSS, du moins après quelques milliers d’heures de deep learning !

Je suis curieusement plus circonspect sur l’adoption de ces technologies. Pour l’heure, elles ne montrent pas un si grand écart qualitatif (même s’il existe), et pour le coût technique (matériel et développement) le résultat est encore bien trop timide. Les grosses productions vont évidemment tenter l’adoption du raytracing, mais cela va rester relativement marginal car pour l’heure le matériel est trop cher, le parc installé quasi inexistant en RTX… donc concrètement peu tentant économiquement parlant. Pire encore: rappelons tout de même que les jeux sont de plus en plus présents sur plusieurs plateformes, et que seule celle du PC gère cet aspect.

ça me rappelle le Glide de 3DFX: une technologie propriétaire, sexy sur le papier certes, mais finalement abandonnée au profit des solutions natives et donc dissociées d’une seule marque de matériel.

Le RT est prévu sur PS5

C’est quoi le 99ème percentile machin au juste ? : /

C’est la valeur telle que 99 % des valeurs mesurées sont au dessus.

le downgrade est impressionnant contrairement aux Graphismes du jeu qui sont franchement moyens à quoi ça sert de mettre 700 voir plus dans une carte graphique si c’est pour ce retrouver avec des jeux qui sont en 2019 au niveau d’un Crysis 3 sortie en 2013 est encore au dessus, le Bullshit atteint des niveaux Olympiques et les gens mangent la merde c’est ça le pire.

le trailer de l’E3 se la pété avec un visuel de folie et on se retrouve avec cette merde.

Merci pour ce test par contre je constate encore une fois que seul un cpu intel est utilisé, va falloir penser à changer vos habitudes vous pensez pas?

“Nos habitudes” ? “Encore une fois” ?

“Afin de ne pas être limité par notre configuration classique de test, basée sur un Ryzen 5 1600X et typique d’une machine de milieu de gamme, nous avons cette fois-ci choisi d’utiliser une configuration haut de gamme à base de processeur Core i7-8700K.”

Allez, ce n’est pas grave, on accepte à l’avance vos excuses 😉

Certes, mais pour cela il existe des équivalents coté AMD aussi, une seconde génération de Ryzen ou un Ryzen 7 par exemple qui coûte moins cher qu’un CPU Intel de gamme équivalente.

ça serait pas mal 😉

En trois mois les choses ont pas mal évolué (et c’est tant mieux), donc à voir 😉

Vous ne notez pas dans votre test le plus gros point négatif de ces technologies. Par exemple pour le DLSS le résultat est purement dépendant de la volonté de Nvidia de fournir des milliers d’heures de deep learning. Donc seulement pour les gros hit en gros …

Quant au raytracing, encore faudrait-il prévoir le jeu pour. Les scenes que vous nous montrez prouvent bien, pour ma part, que le jeu n’a pas été pensé artistiquement pour, tant certaines scène cruciales sont sombre faute de la luminosité ambiante magique qu’appliquent classiquement les devs et faute de lumière supplémentaire ou de surface réfléchissante capable de faire le job.

En conclusion : le résultat du raytracing est hautement dépendant de la volonté et du temps des devs à faire deux version artistique de leur jeu et le résultat du DLSS est hautement dépendant du temps que Nvidia veut bien y mettre, et donc de la grosseur de l’opus.

Par ailleurs, pour connaitre un peu la technologie utilisé (réseau de neurone et cie) et pour bosser régulièrement avec depuis des années, j’emet un sérieux doute quant à la capacité de Nvidia a améliorer les choses pour le DLSS. En effet, ce genre de technique à une efficacité proportionnelle à la diversité des images en sortie. Donc sur un petit jeu ou sur un test 3Dmark il peut donner un très bon résultat, mais sur un monde très complexe et divers comme ceux qui sont représenté dans les gros hits … automatiquement ce genre de réseau ne pourra alors guère briller au delà d’un certain pallier.

C’est donc assez paradoxale car en moyenne le DLSS sera moins efficace et plus flou pour … les gros hit, qui sont justement les seuls jeux qui en profiteront pleinement …

Autre paradoxe qui vient doubler celui-ci, le DLSS applique des upscale différent selon la résolution et donc la qualité sera meilleure sur l’upscale à 133% que sur celui à 150%. Mais, et c’est là le paradoxe : la technologie est utile uniquement sur les grosses résolutions, qui applique l’upscale à 150% .

Dans les deux cas -> Là ou le DLSS sera utile sera donc là ou il sera toujours le plus mauvais. Une technologie qui débute avec de sacré bâton dans les roues …

Vous ne faites pas non plus de commentaire sur le cout induit sur l’utilisateur. Comme on a pas le choix c’est difficile de comparer, mais pour deux technologies qui sont assez branlante pour le moment, difficile de ne pas tiquer devant l’augmentation du nombre de transistor qui semble nécessaire pour les faire tourner (unités RTcore et Tensor). Ce nombre induit donc une belle augmentation du cout de la CG, et on peut légitimement se demander si Nvidia n’est pas en train de faire payer à prix d’or son paris technologique au consommateur …

assez d’accord avec commentaire bien construit. Au vue du prix de cette génération, l’apport et l’intérêt de ces nouvelles technos est faible. Le résultat visuel n’est pas probant, les comparaisons d’images ne permettent pas de se rendre bien compte car les screen “RT ON” sont systématiquement trop sombres. En même temps si on éclaircis ces screens ont n’obtiendra un résultat youtube avec des noirs délavés pour voir qqlchose sur les vidéos.

Concernant le fait que les dev devrait proposer 2 visions de leur jeux n’est pas vraiment viable, par contre une meilleure implémentation ou une meilleur usage pour la gestion de la lumière ou d’autres effets apporterait un plus comme à l’époque du physX ou plus récemment du hairwork/tressfx.

Attends, tu parles de surcout, mais franchement, l’écart de prix de vente neuf entre une 1080 et une 2070 était assez faible lorsque ces deux modèles étaient encore côte à côte sur les rayons… Alors remettons un peu l’église au milieu du village, une 2070 est PLUS PUISSANTE ET OFFRE DES FONCTIONNALITES SUPERIEURES à une 1080 ! Pour un prix qui reste SIMILAIRE !

On peut alors parler du marcher de l’occasion ou vous trouverez des 1080 à 350€… une 1080 à 350€, quand on connaît la fragilité des GPU, moi je ne vous le conseille pas…

Bonne soirée, mais stop la mauvaise foi, merci !

PS : le RT est probant, vraiment ! Tu ne peux pas juger sur 4 images statiques….

(J’ai l’impression d’être un commercial Nvidia alors que je tenais les mêmes propos avant d’avoir essayé le RT sur metro)

Tu m’a mal compris. Avec les prix des transistors actuellement, et si on étudie le fonctionnement, les caractéristiques et les gravures donné par Nvidia on se rends compte que sa nouvelle génération de carte graphique, sans le DLSS et le RTX aurait été environ 1/5 à 1/4 moins cher.

Et comme tu le note bien, le problème de Nvidia c’est que le prix reste très similaire à sa génération précédente.

Donc sans le surcout de la RTX et DLSS nvidia aurait du diminuer ses prix de la génération précédente pour continuer à écouler son stock !

En clair et en résumé : le RTX et le DLSS sont une excellente astuce commerciale. Elle permet de maintenir le prix de la génération précédente et actuelle au standard qui avait été fixé pour les Geforce 10xx, alors que les couts de fabrication et de matière première ont fondu. Nvidia, avec cette opération commerciale à fait exploser sa marge commerciale, en ayant une très bonne excuse pour le faire.

Quant au RT : c’est une technologie assez sympathique mais qui coute énormément de transitor. En clair, sans RT et DLSS, à nombre équivalent de transitor, tu aurait pu avoir la puissance d’une 2080ti au prix d’une 2060.

Par ailleurs on peut douter de l’évolution du rendu een raytracing dans le futur. La nature même de cette étape de rendu fait que pour augmenter la qualité de, disons, 2 fois, il faut augmenter la puissance de calcul de bien plus de 2 fois. Et il semble strictement impossible de le faire actuellement et ça peut-être douteux dans le futur pour des questions de physiques.

Salut, ton commentaire reflète ton esprit d’analyse très fin !

Cependant, un détail par rapport au ray tracing : quoi de mieux que l’empirisme pour juger de la pertinence de ce nouveau système ?

Eh bien après avoir passé 4h avec ray tracing activé, il m’est impossible de revenir en arrière, même si le jeu n’est “soit disant” pas étudié pour. Cela te laisse imaginé le potentiel pour un jeu développé avec et pour.

Très honnètement, j’ai une 2070 RTX, je ne l’ai pas acheté pour le RT, mais parce qu’on me la vendait moins chère qu’une 1080 GTX….

Une fois le RT activé dans Exodus, le sentiment d’immersion est beaucoup plus présent. C’est tout juste perceptible, mais en fait, le RT donne une plus grande impression de profondeur. Par exemple, un hangar de 10m de haut paraîtra ne faire que 4 ou 5 m avec les éclairages “artificiels” alors qu’avec le RT, on a effectivement l’impression qu’il est énorme.

Je préfère diminuer les qualité générales et jouer avec plutot que de tout mettre en extrême et de m’en passer, c’est dire !

Ensuite, le DLSS, … C’est tout simplement de la m***de. Pour moi, c’est simplement un AA assez bon appliqué à une résolution inférieure. => CACA, même GROS CACA.

Une bise, mais un conseil, attendez un peu quand même avant d’investir dans le RT…. un à deux ans encore et on verra.

Comme je l’ai répondu au commentaire précédent : vous réfléchissez beaucoup en tant que consommateur qui étudie les prix sur l’étale du marchand, et non en tant qu’industriel.

Sans le Rattracing et le DLSS et ce que ça coute en transistor sur la CG, Nvidia aurait du diminuer ses prix pour la génération actuelle. Tu aurais donc eu, par exemple, une 2080ti au prix d’une 2060. Ça fait réfléchir non ?

Plus important encore, Nvidia aurait été obligé de diminuer le prix de sa génération précédente drastiquement pour continuer à écouler du stock.

En clair, en introduisant au forceps ces deux technologies Nvidia fait un coups de maitre d’un point de vue commerçant : il maintient le prix de sa génération précédente très haut (alors que les prix des matériaux et du procédé de fabrication ont baissé) et maintient la ligne de prix fixée par sa génération précédente sur sa nouvelle génération. C’est tout benef pour eux. Beaucoup moins pour le consommateur.

Le problème principal c’est surtout que sur touuuuuuut les jeux (et il y en a beaucoup) qui n’utilise pas le DLSS et le RT. (pas mal de type de jeu n’en auront rien à faire de ces deux tech) . Alors toute cette zone de transistor sera “morte”. C’est donc du pure achat gratuit d’un point de vue consommateur.

Enfin, technologiquement, il y a de bonne raison de douter du futur du raytracing. Si tu veut appliquer un raytracing “complet” sur une image en temps reel, il faudrait une carte graphique 10000 fois plus puissante que celles qui sont disponible actuellement. Le raytracing est un procédé qui a un défaut : pour augmenter, disons, de *2 la qualité d’une image, il faut augmenter de bien plus de *2 le cout de calcul. C’est exponentiel. Le résultat des course derrière, c’est qu’il sera trèèèèès difficile de dépasser le résultat actuel, pour des raisons de physique, tout simplement.

Le risque derrière c’est que la partie “raytracing” des carte nvidia servent à l’infini à justifier des prix haut même si le cout des matériaux diminue, sans avantage pour le consommateur et sans évolution du résultat actuel. Et même peut-être au prix d’une stagnation de la puissance brute des CG (vu que Nvidia peut augmenter la taille de cette partie de ses CG sans se faire chier à pondre une nouvelle archi sur le reste).

Mon avis rejoint finalement ta recommandation finale : attendez avant d’acheter, car Nvidia vient d’ouvrir une grosse brèche à AMD, et la réaction d’AMD jouera énormément sur le futur des CG. De plus on pourra bien plus étudier le futur de ces techs quand on verra qui les adopte ou non dans les prochains mois.

Les consommateur qui réfléchissent comme des industriels, les employés qui réfléchissent comme des patrons ?

Chacun défend sa crémerie.

Bonjour

Le prix des cartes est très correcte par rapport a la techno utiliser.

Sincerement je ne pensai pas le raytracing possible avant …. Le futur !

Aujourd’hui les jeux passent un gap au prix de petite concession.

A l’époque des ps1 on acceptait le passage a la 3d avec 20 images par secondes … Aujourd’hui on a une techno qui doit s’installer mais ont critique ses pauvres 45 ips !

Le rattrapent et le dlss apportent un vrai plus. Essayer s’est l’adopter.

C’est plus attrayant que 144 ips qui n’apportent rien de plus que 60 ips in game. Ont est majoritairement des amoureux des nouveautés et de l’évolution,et le ray+dlss sa c’est l’évolution qui croise le chemin de la course au teraflops.

La rtx 2060 fait mieux qu’une gtx 1080. Désolé c’est comme ça il faut l accepter. Il faut évoluer.

Je pense que le temps nous mettra tous d’accord.

Pour avoir fini le jeu hier, je suis d’accord avec PELLWILL, je préfère baisser les détails et laisser le RT. Sur des images statiques, il n’y a aucune différence, j’ai essayer d’envoyer des screens à des amis, ça ne rend pas. En immersion dans le jeu par contre c’est bluffant, la lumière est là, les particules sur lesquelles elle se reflète rajoute l’effet d’immersion. J’ai prix une RTX2060 parce que c’était moins cher qu’une GTX1070, et bien je ne regrette pas! Le RT ça change tout, mais faut jouer pour s’en apercevoir.